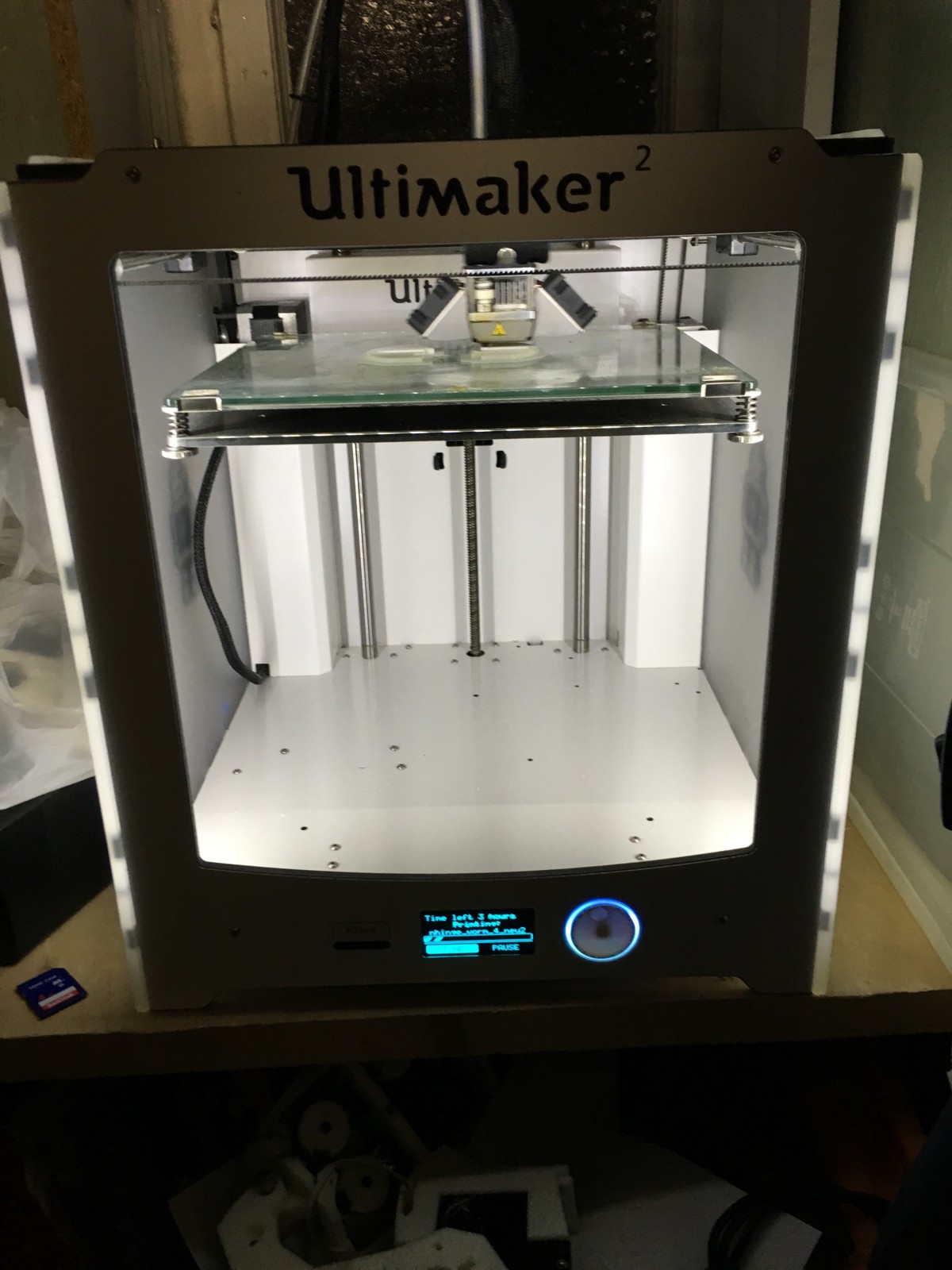

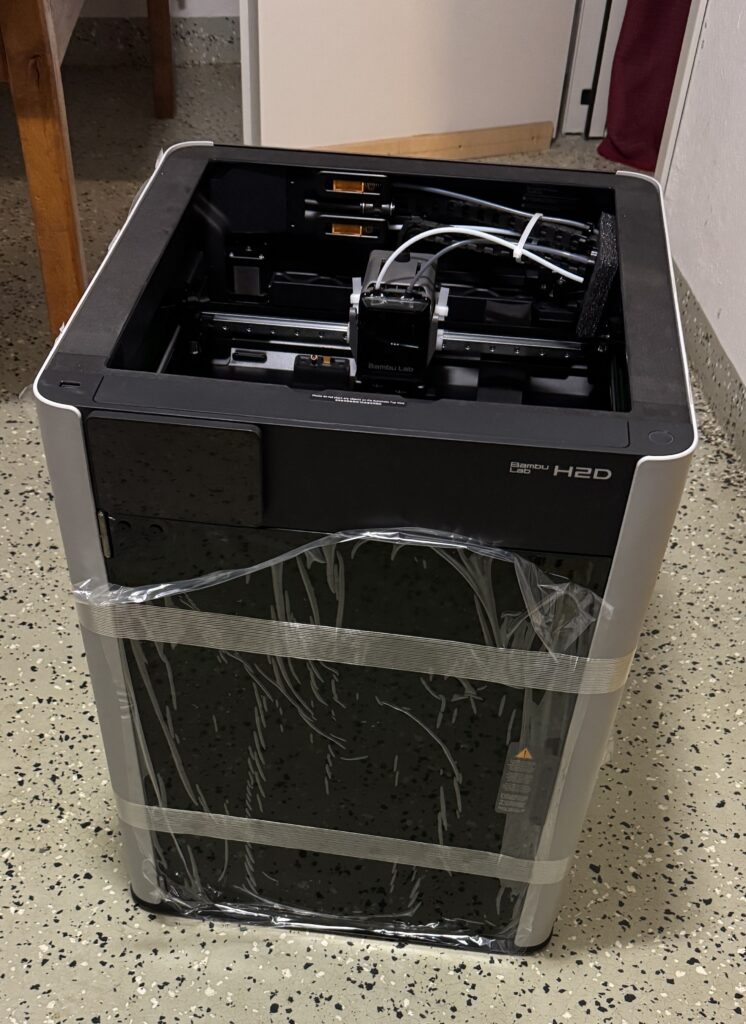

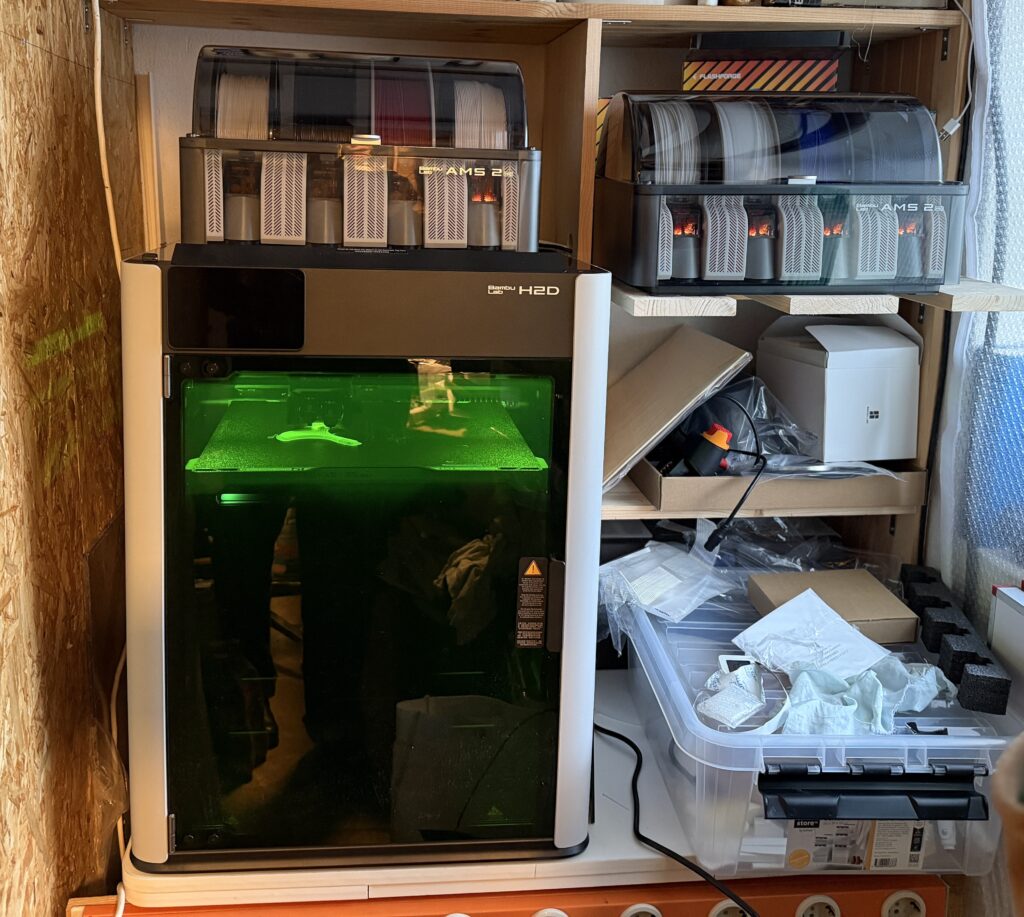

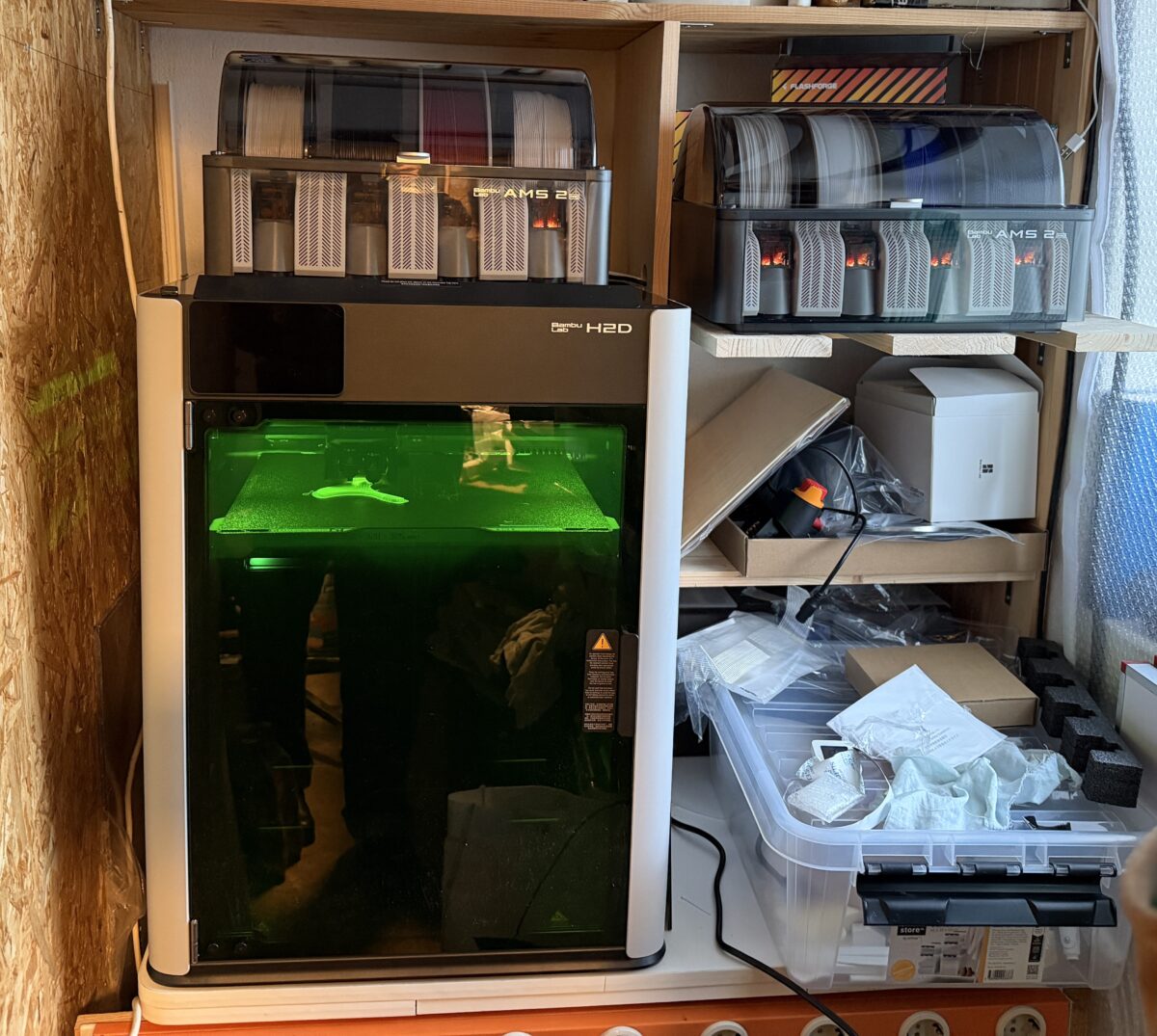

Der neue 3D Drucker H2D . Nach dem Eintreffen gleich ein 2. AMS bestellt, man gönnt sich ja sonst nichts

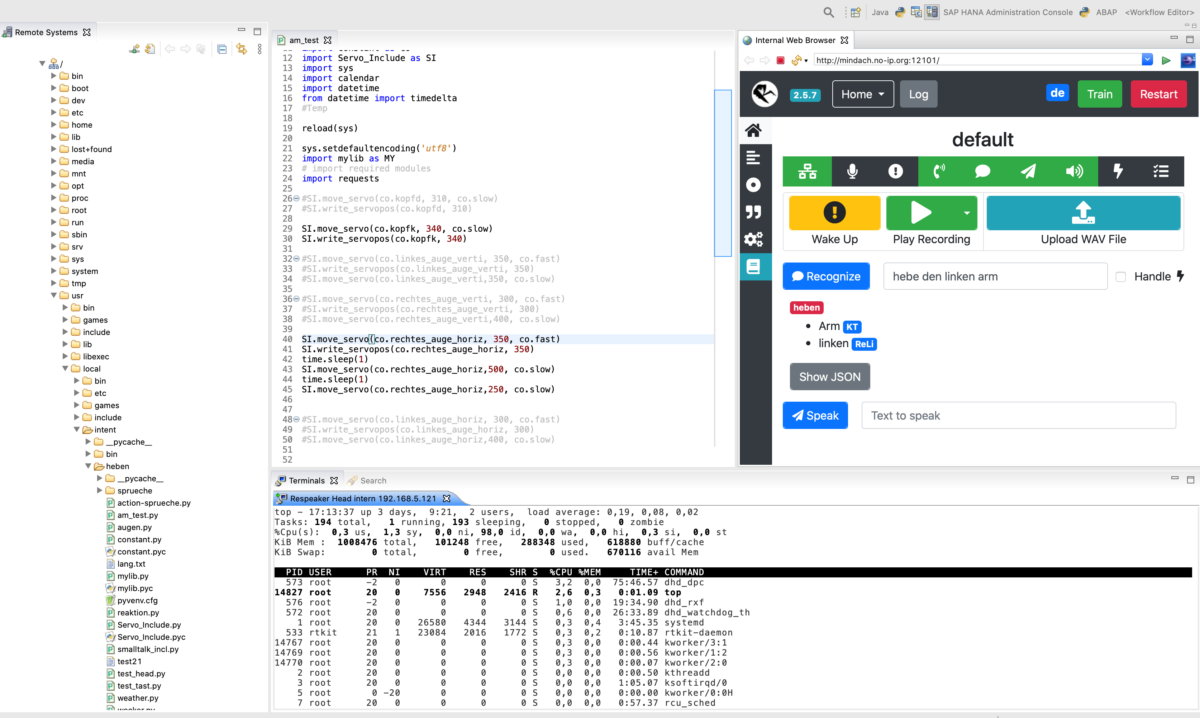

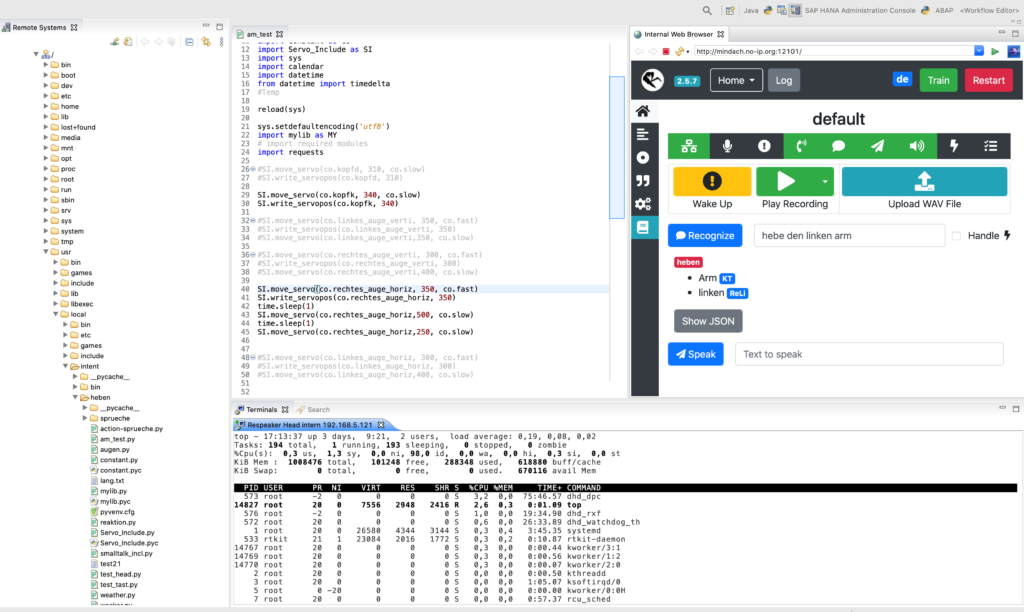

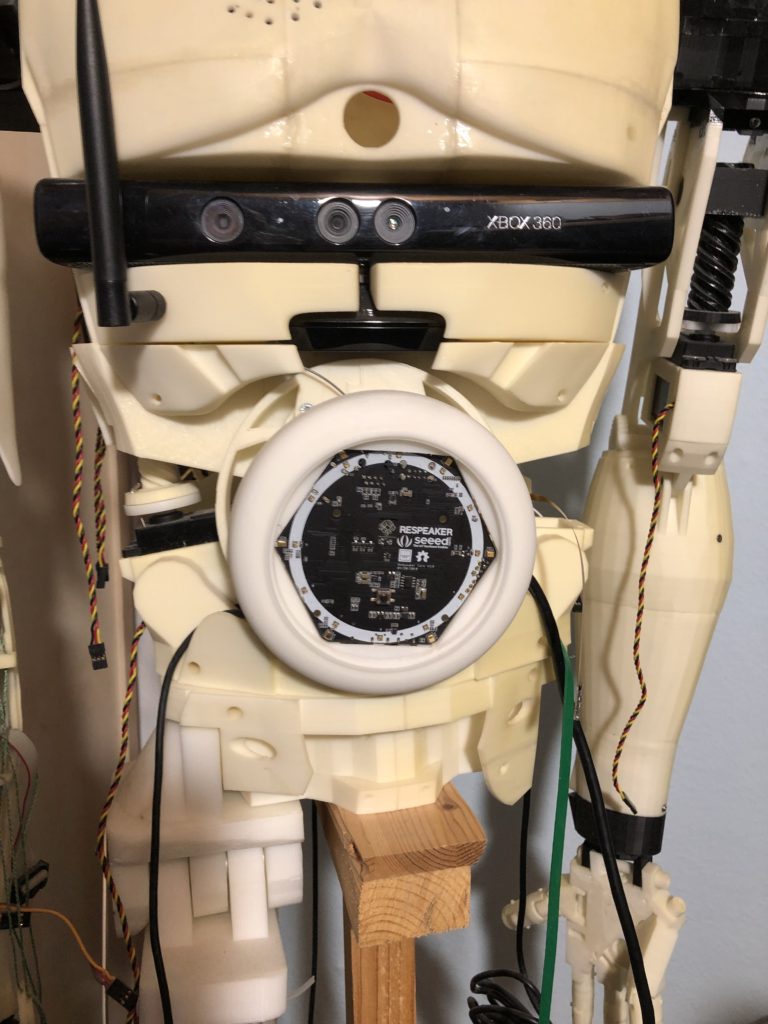

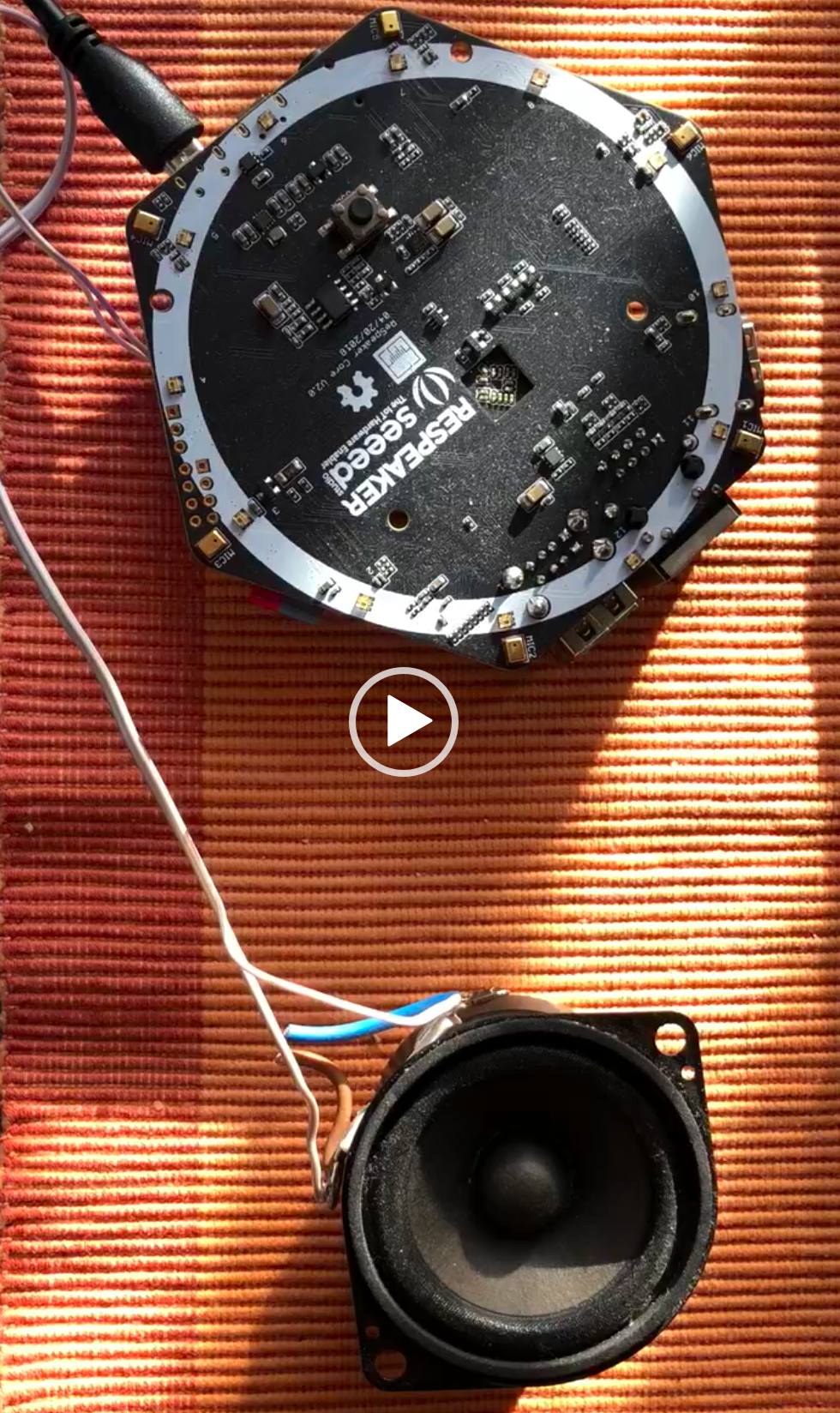

Die eclipse IDE: links der Remote explorer mit dem Zugriff auf den Respeaker Core v2.

In der Mitte die Python Datei zum Testen. Rechts die Weboberfläche für Rhasspy.

Unten der ssh Zugriff auf den Respeaker Core v2 mit einem Debian OS und der Ausgabe von Top.

Auf dem Respeaker läuft ein Docker Image mit Rhasspy 2.5.7 .

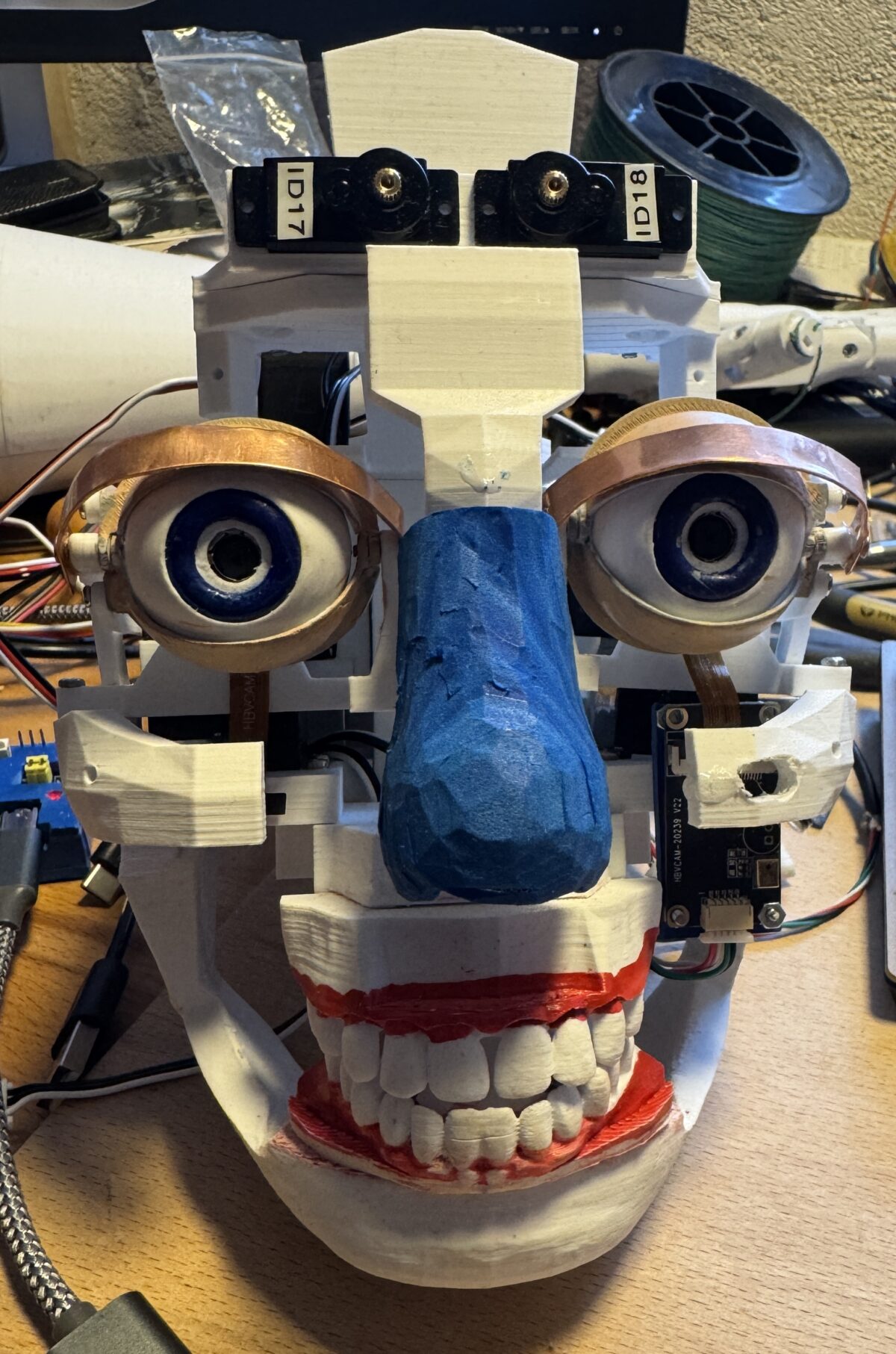

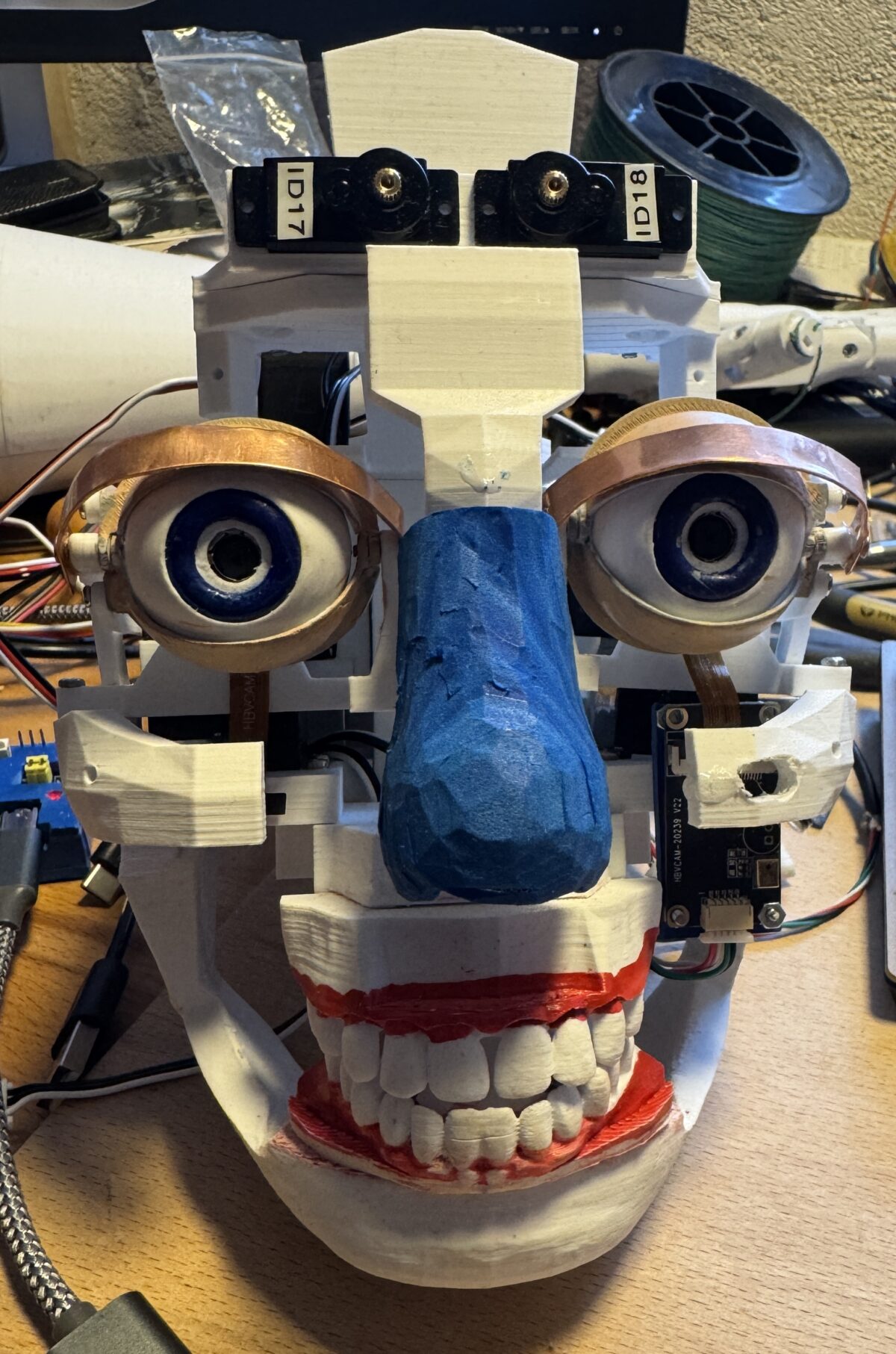

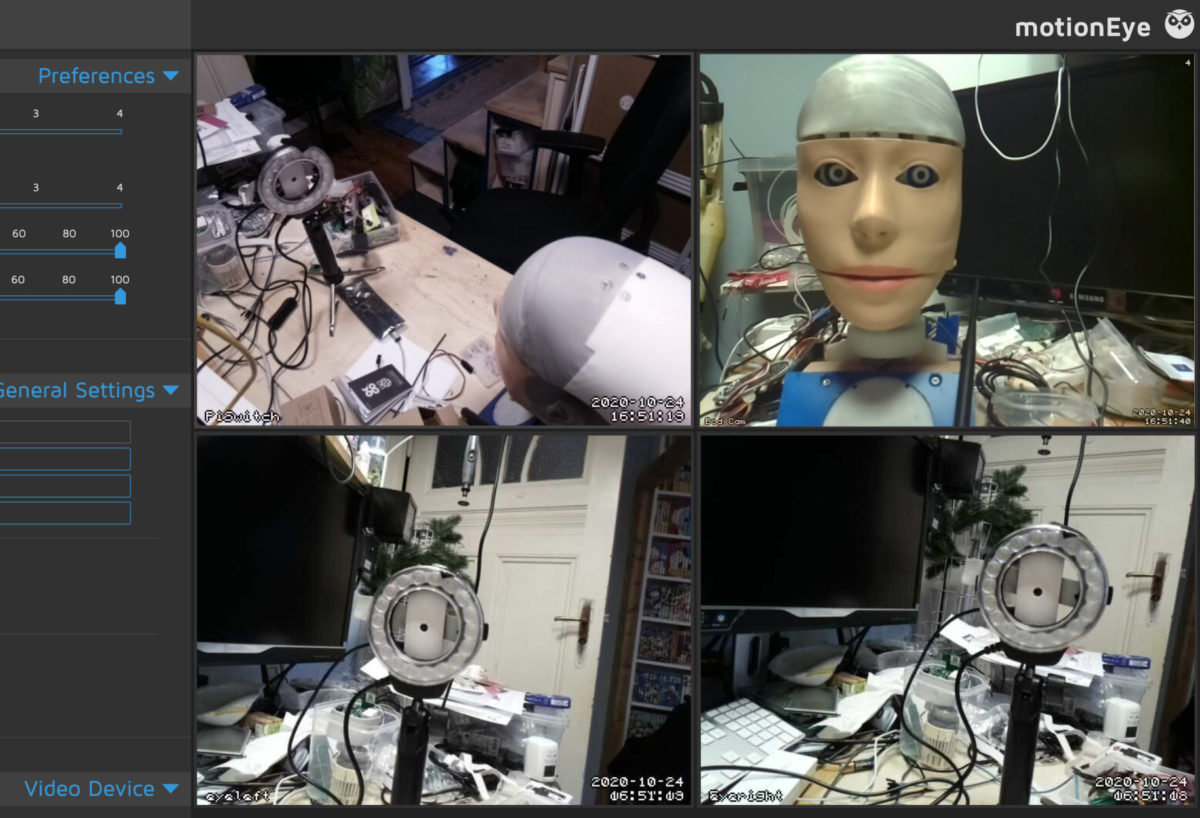

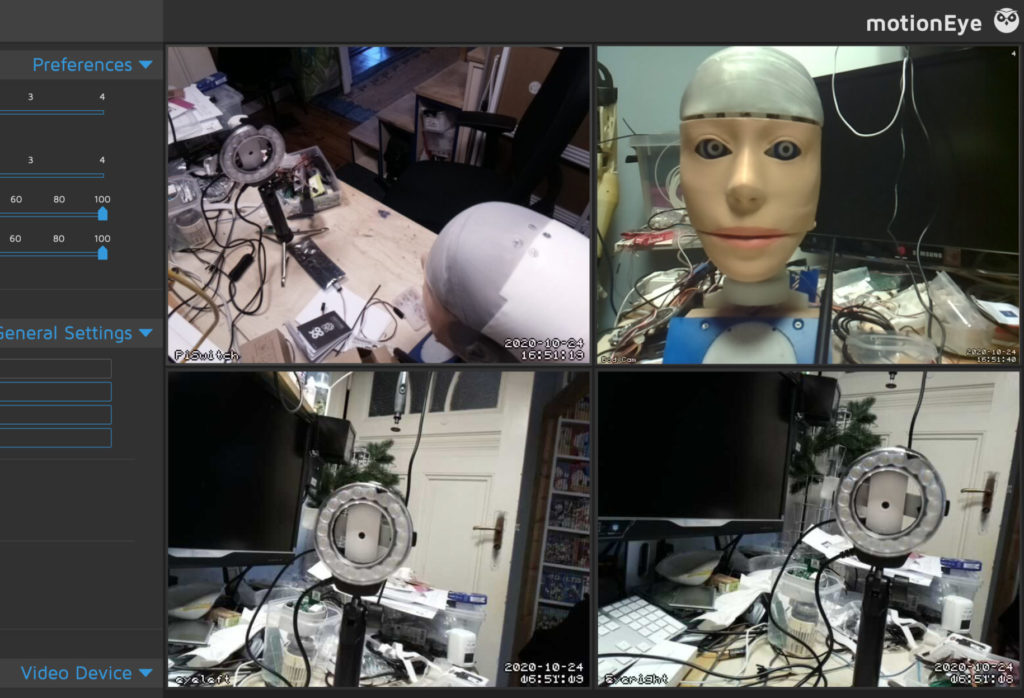

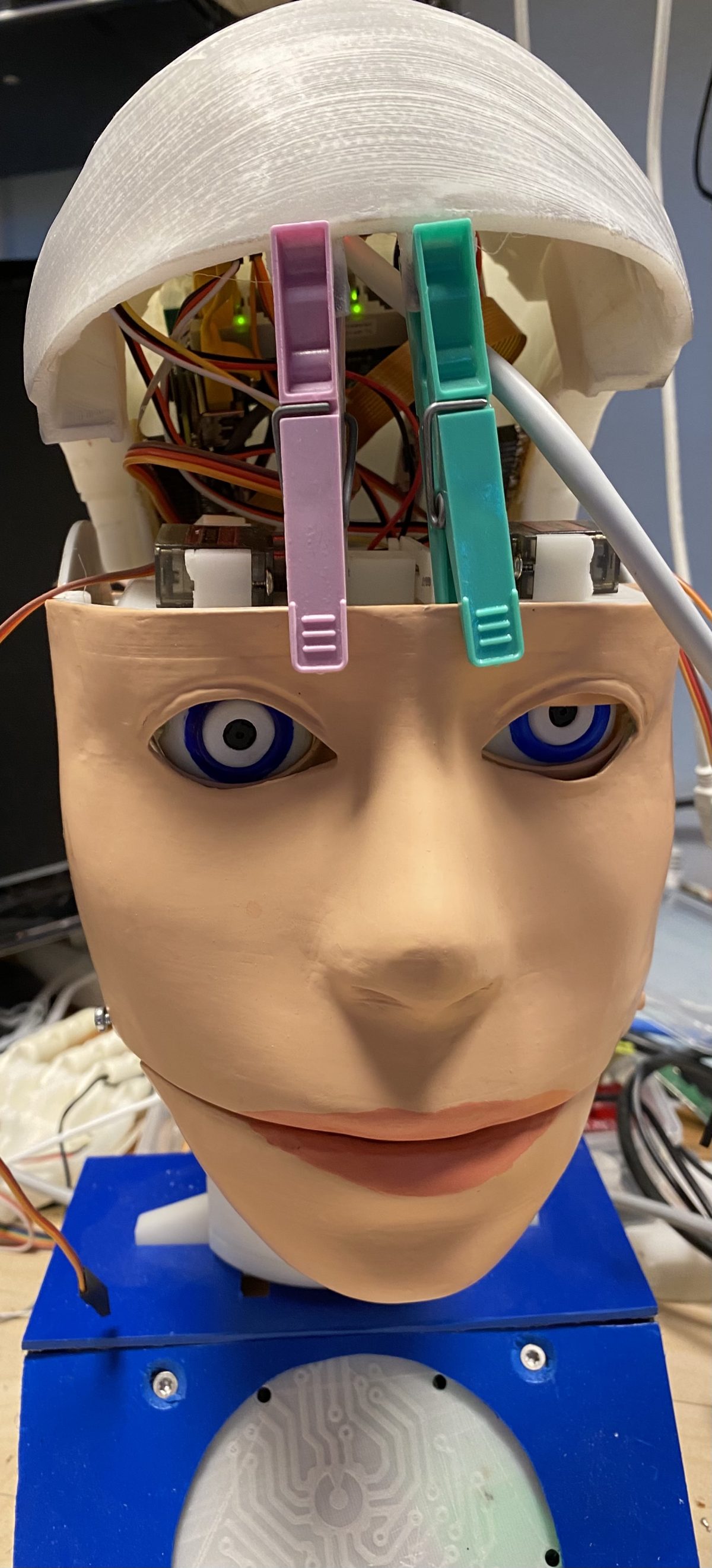

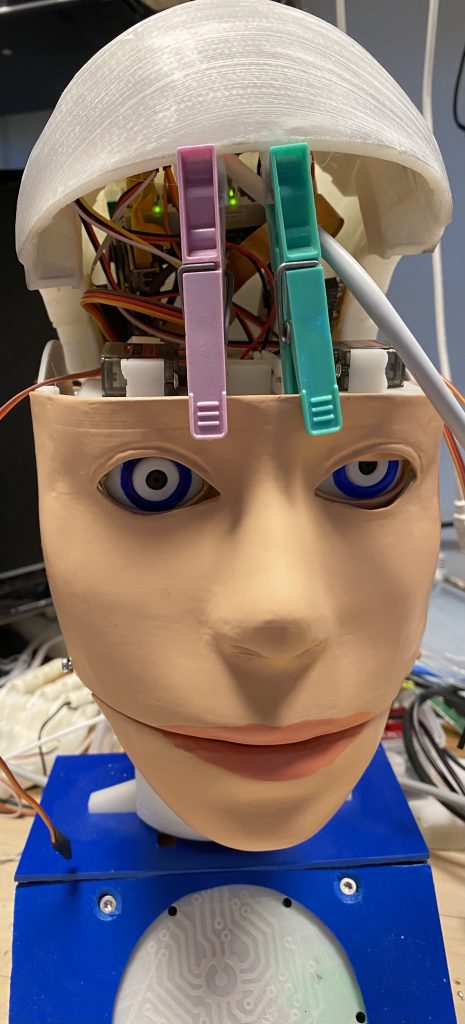

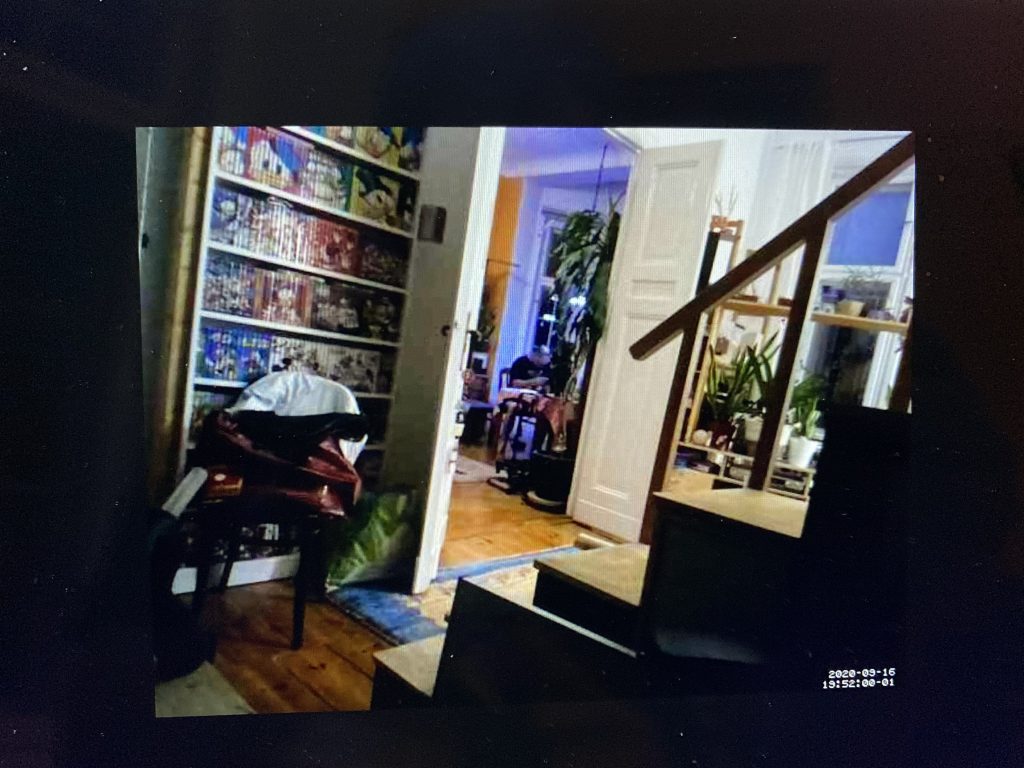

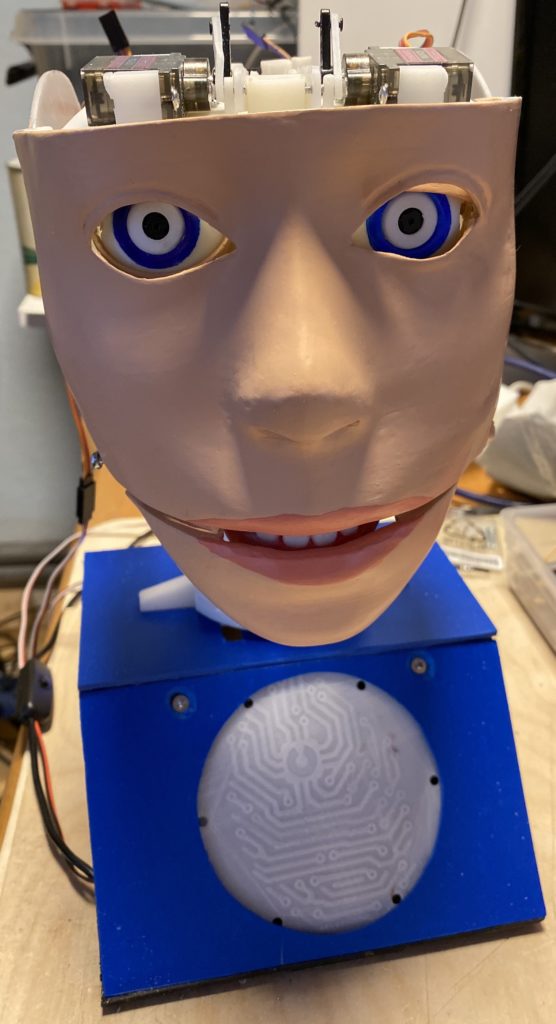

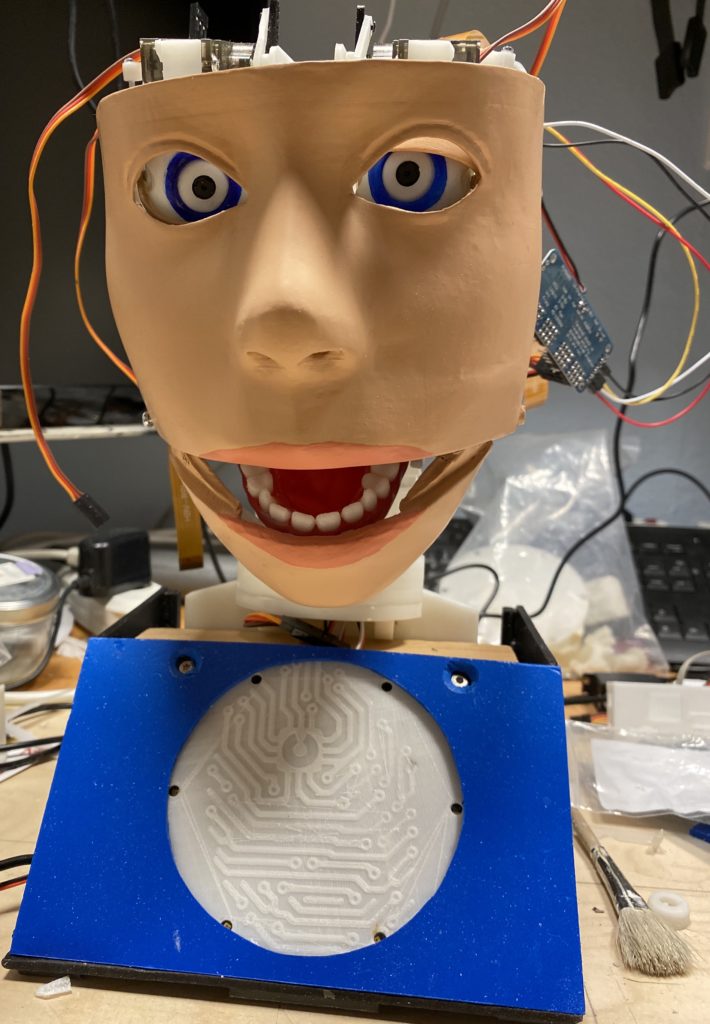

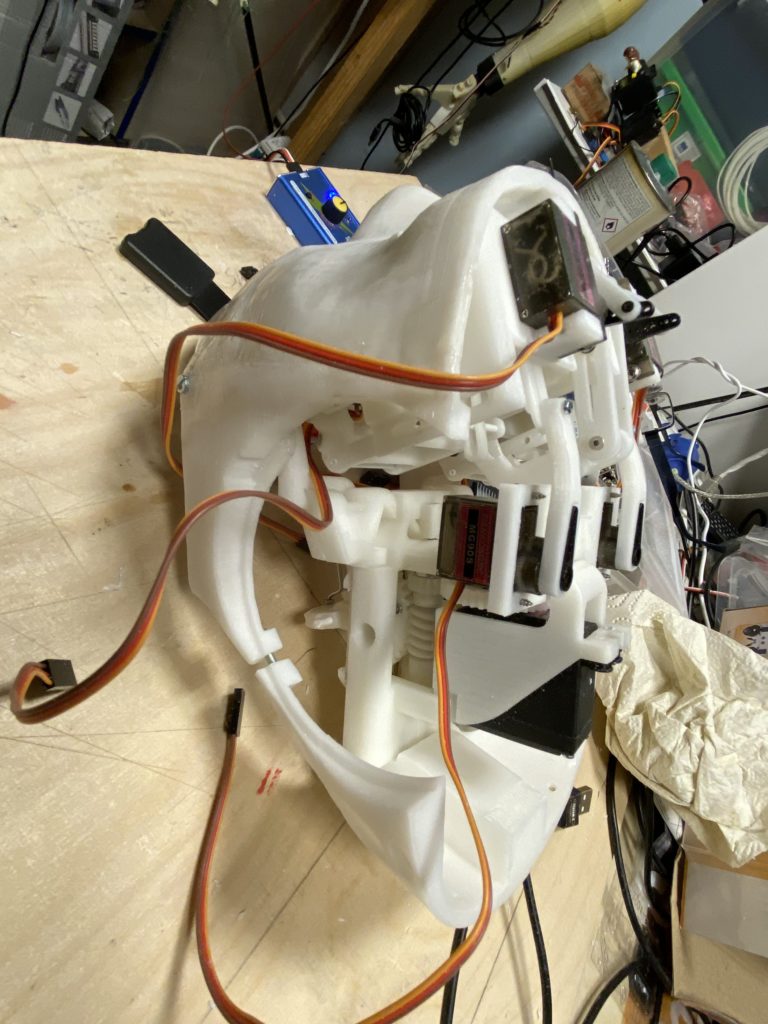

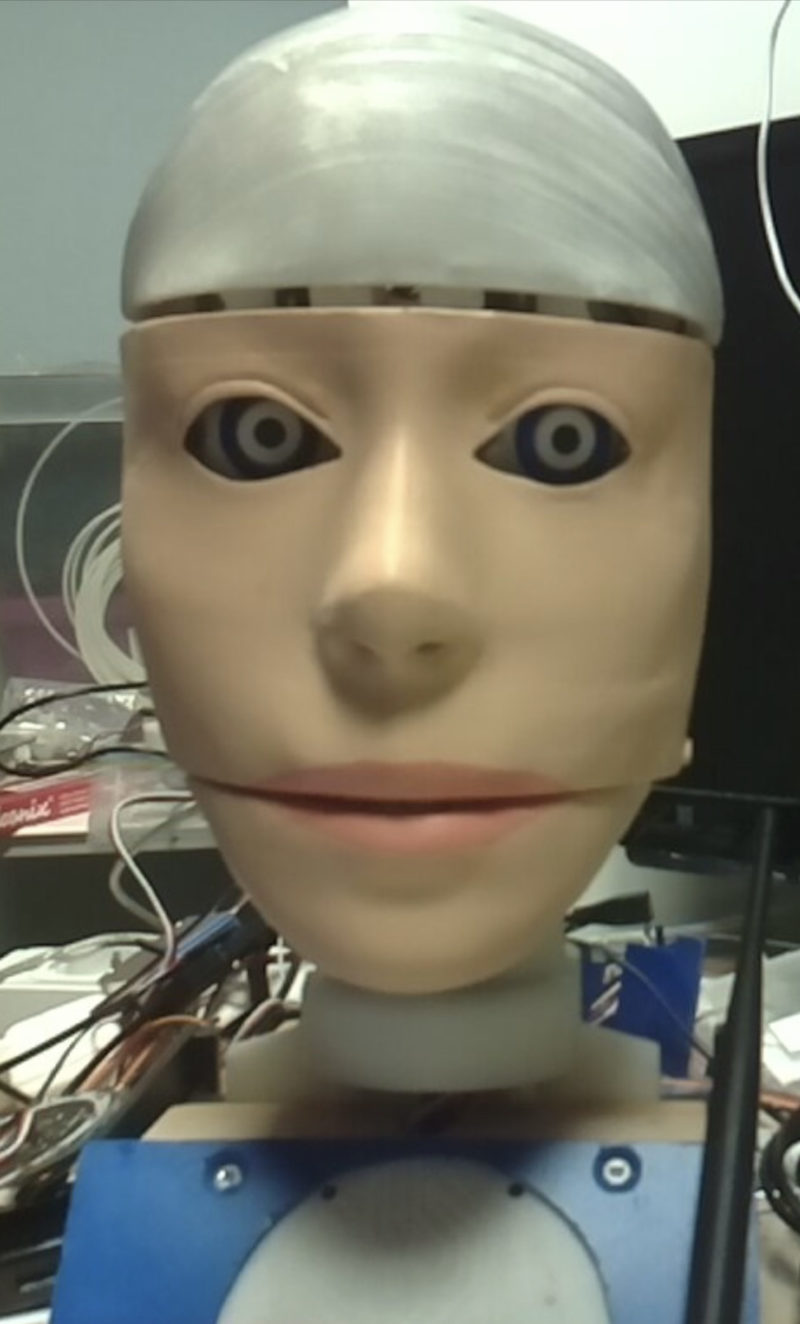

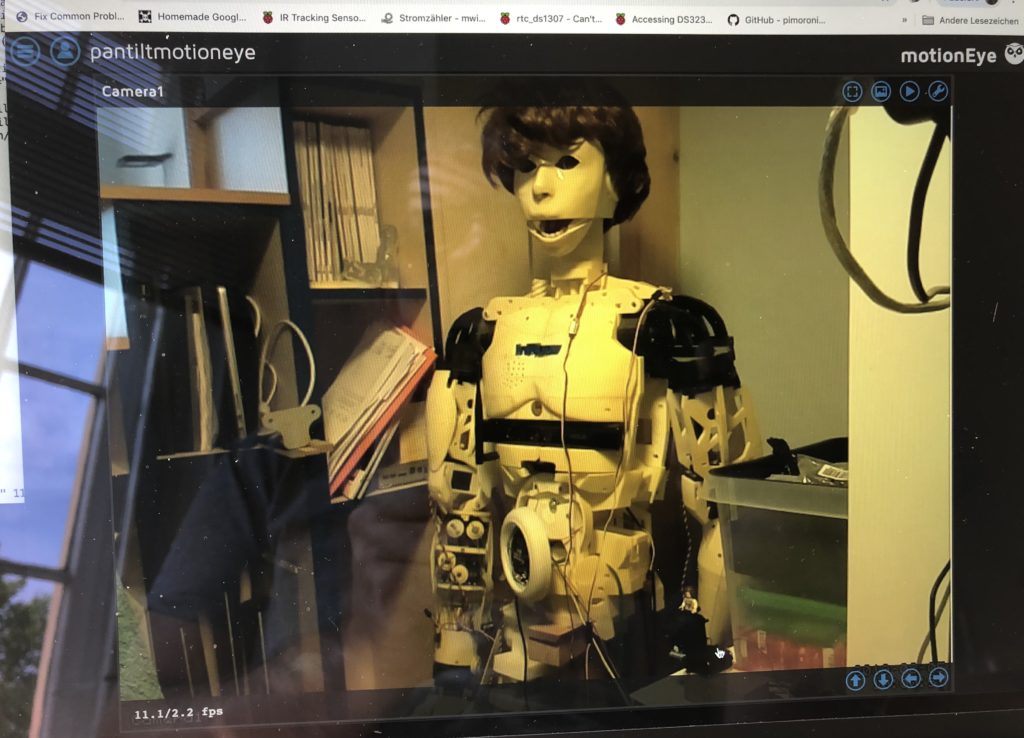

Die Augenkameras zeigen die Lampe die vom Server bei Dunkelheit angeschaltet werden kann

Im oberen Bild sieht man rechts oben die Werkstattkamera links oben der Blick auf den Kopf von der BodyCam.

Unten rechts ist die rechte Augenkamera unten links die linke Augenkamera

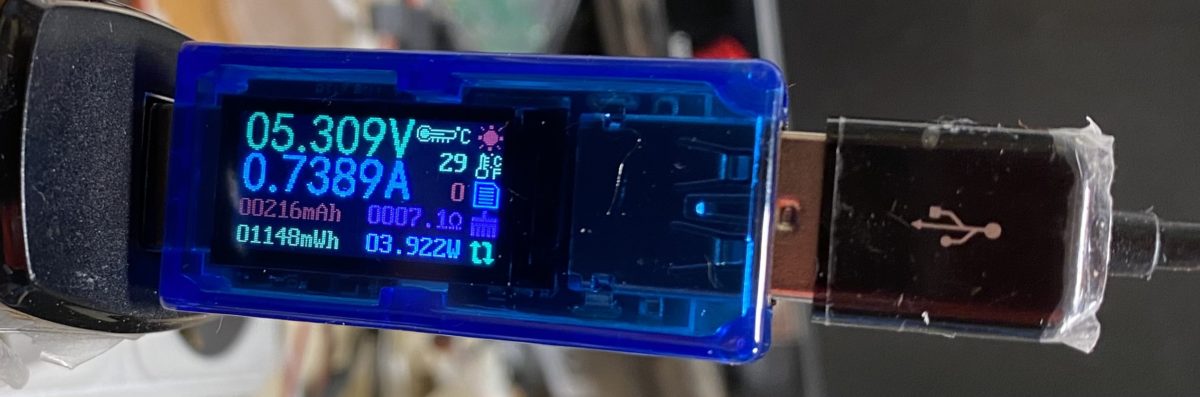

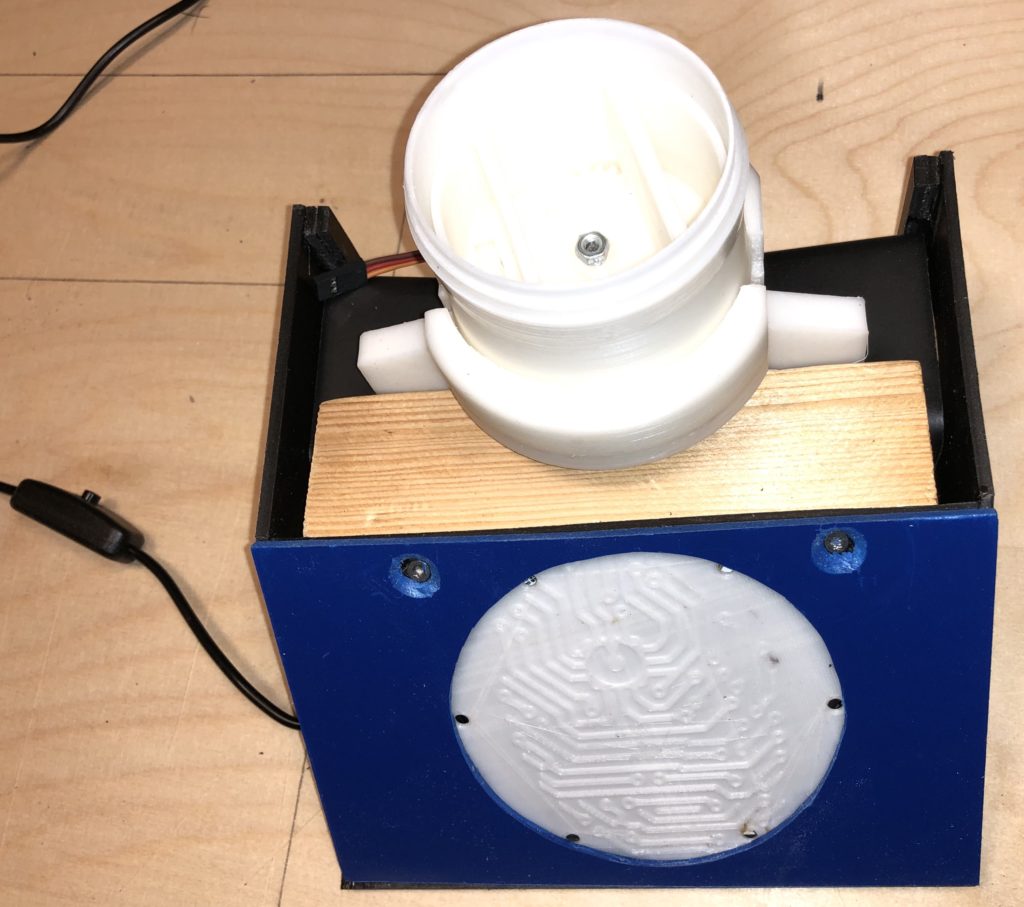

Das ganze mit einem USB-Stick Multimeter gemessen und zeigt den Stromverbrauch des Kopfes

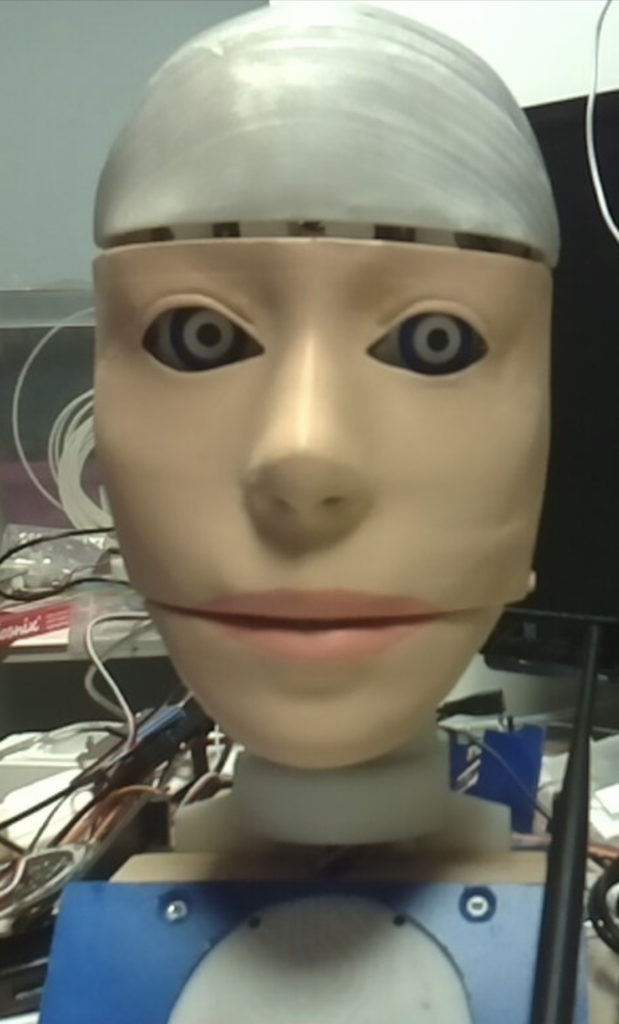

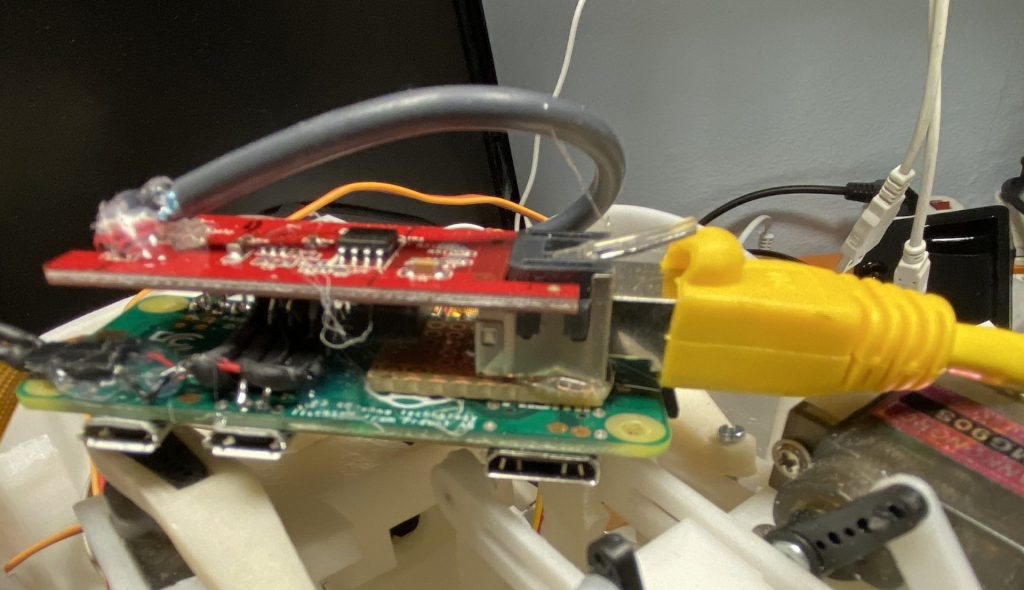

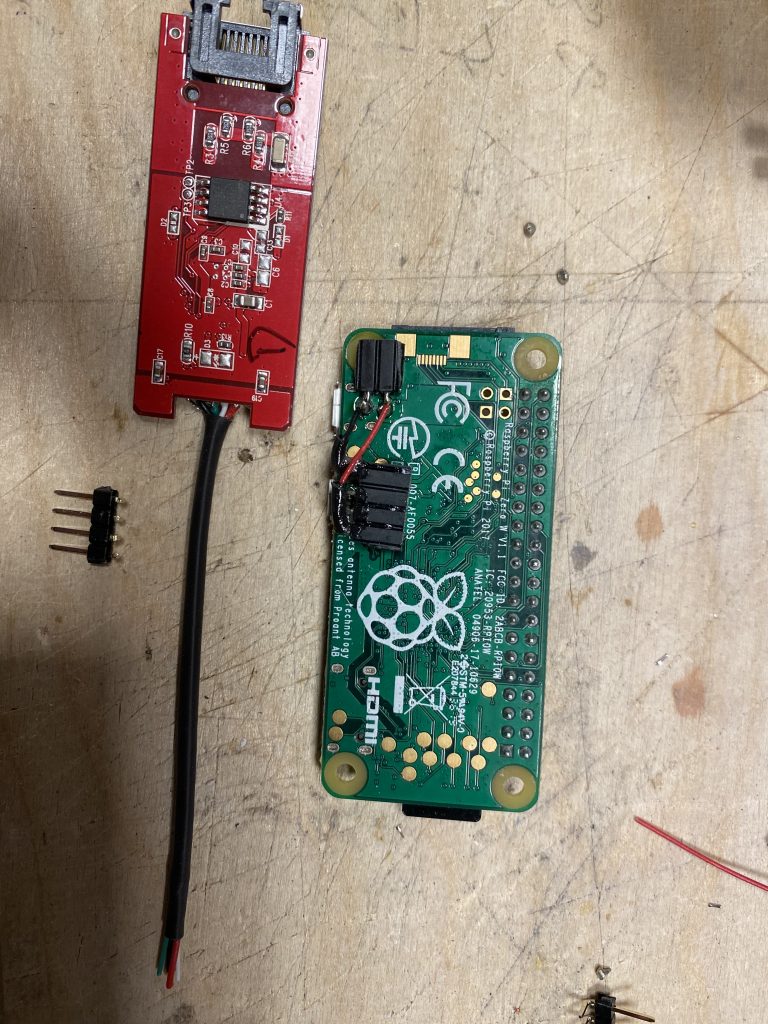

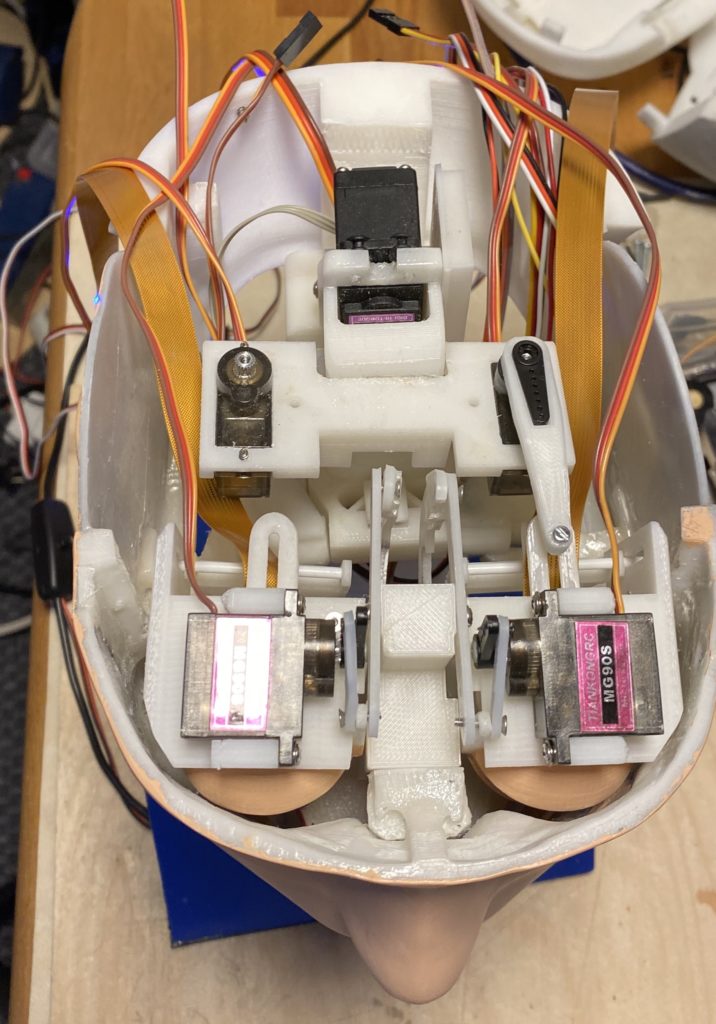

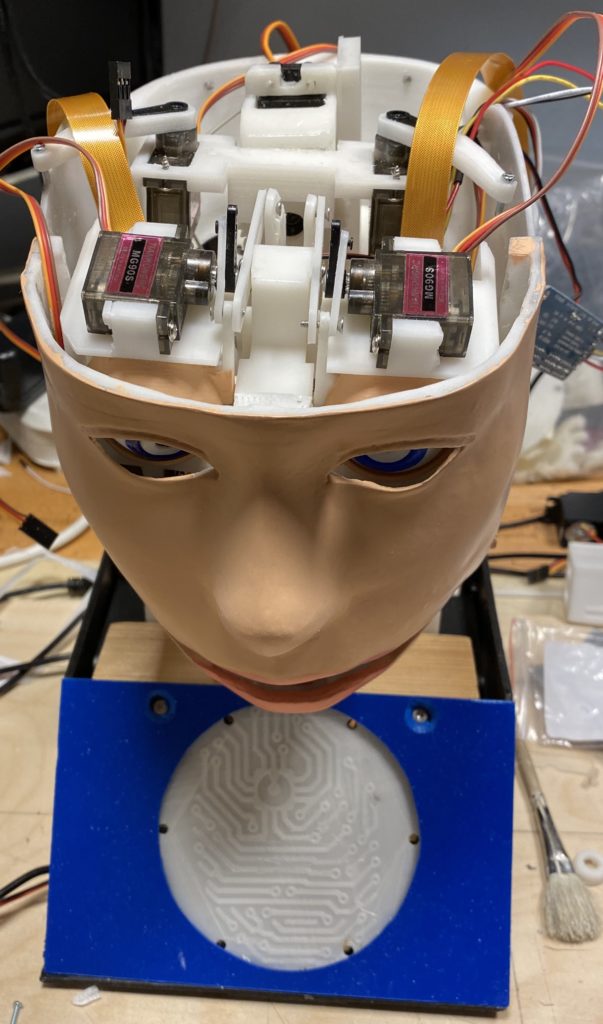

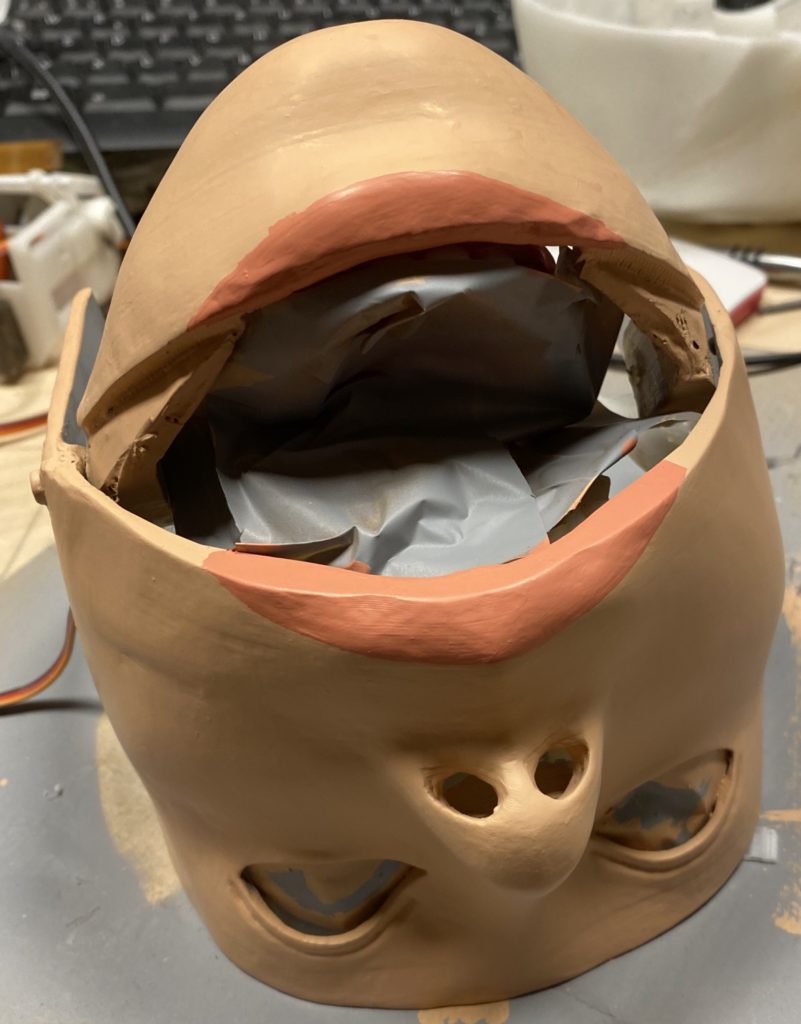

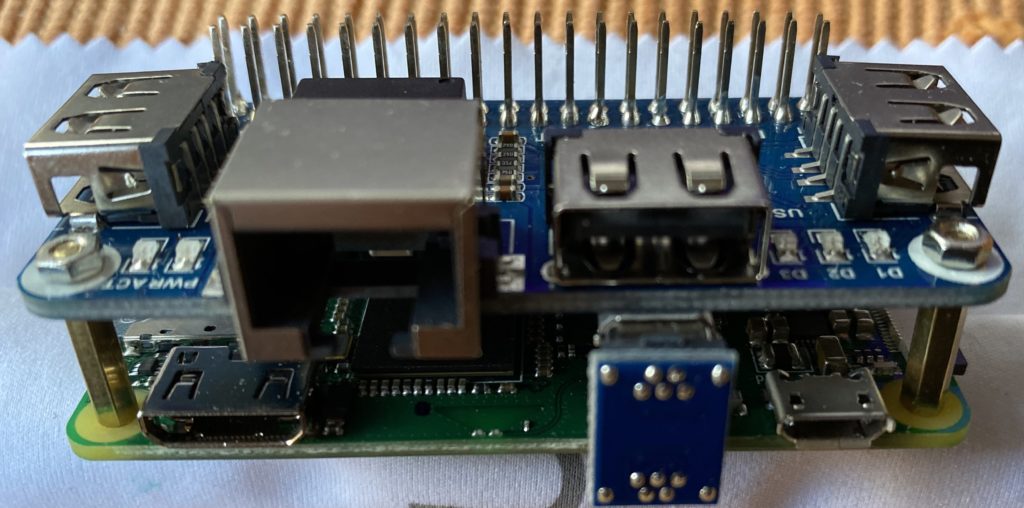

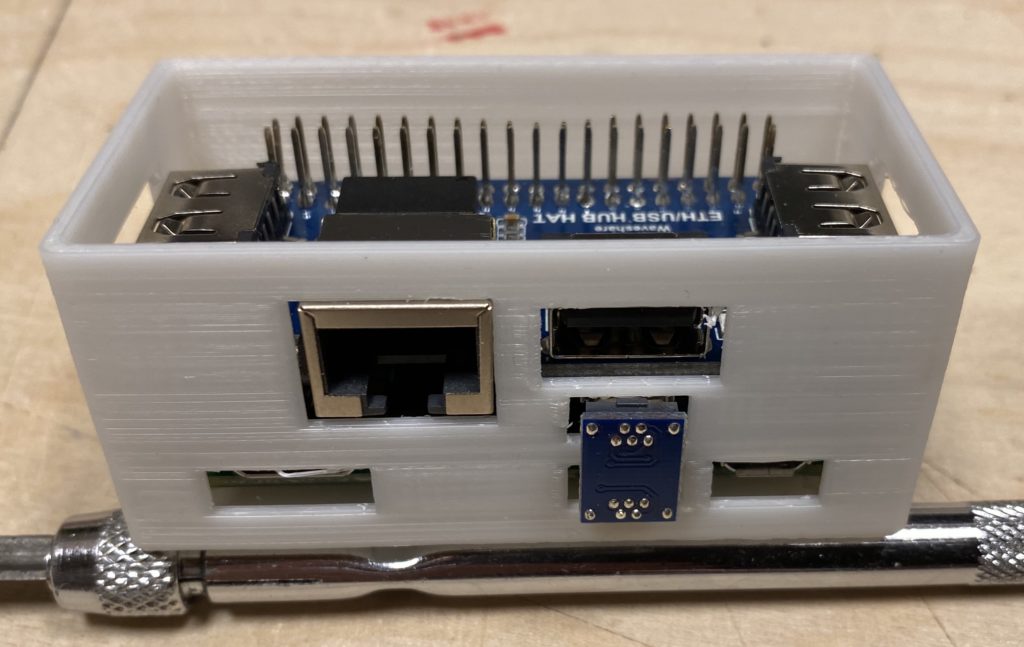

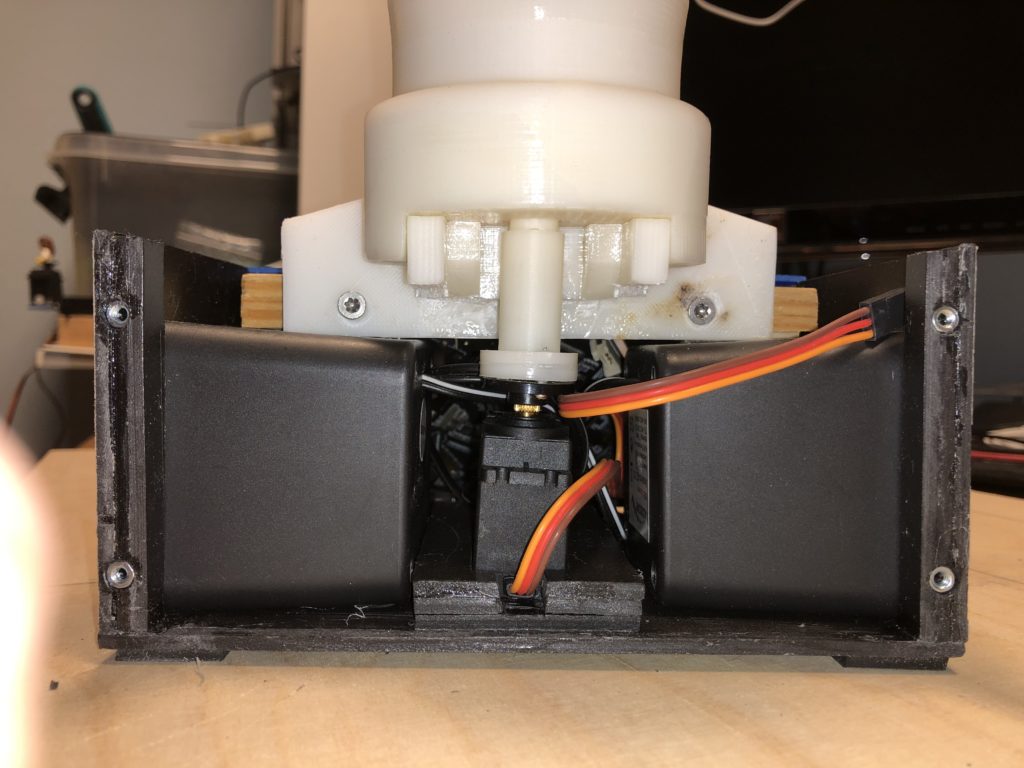

Im inneren des Kopfes werkeln 2 Raspberry Pi zero + USB to Ethernet adapter + 5-Fach Switch. Auf den RpI’s läuft motion um die Augenkameras als Stream zur Verfügung zu stellen.

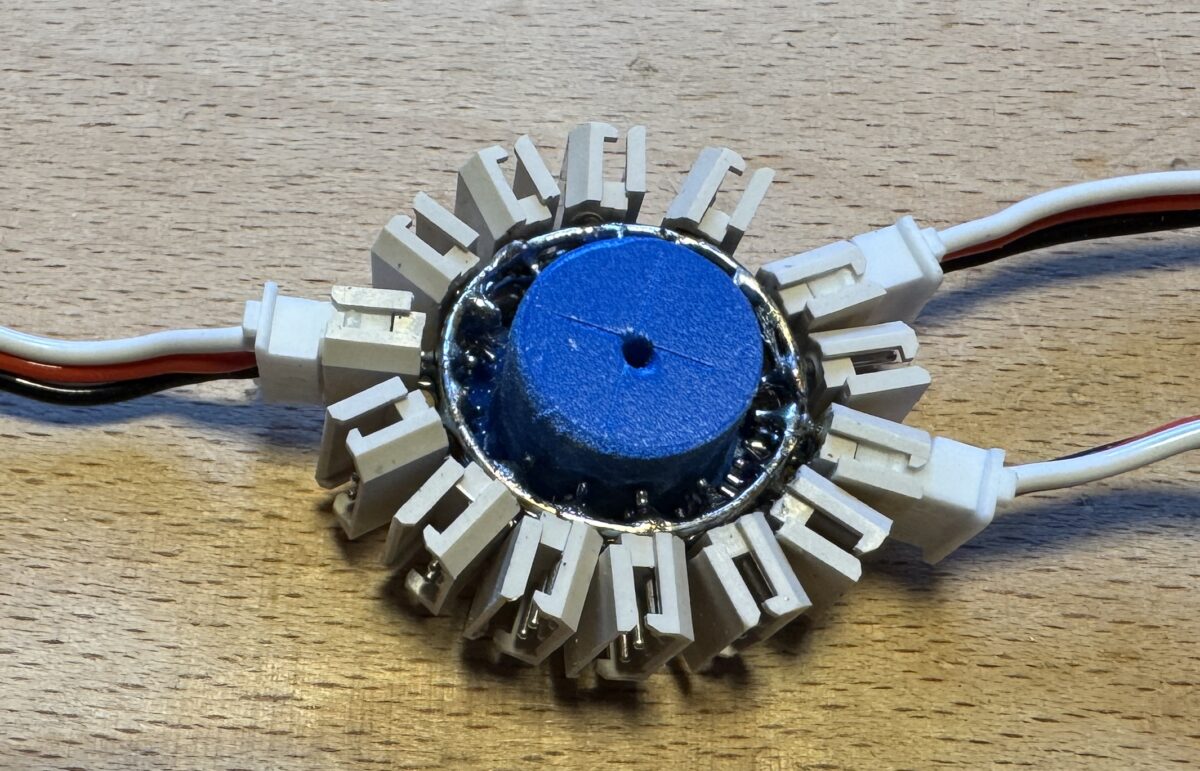

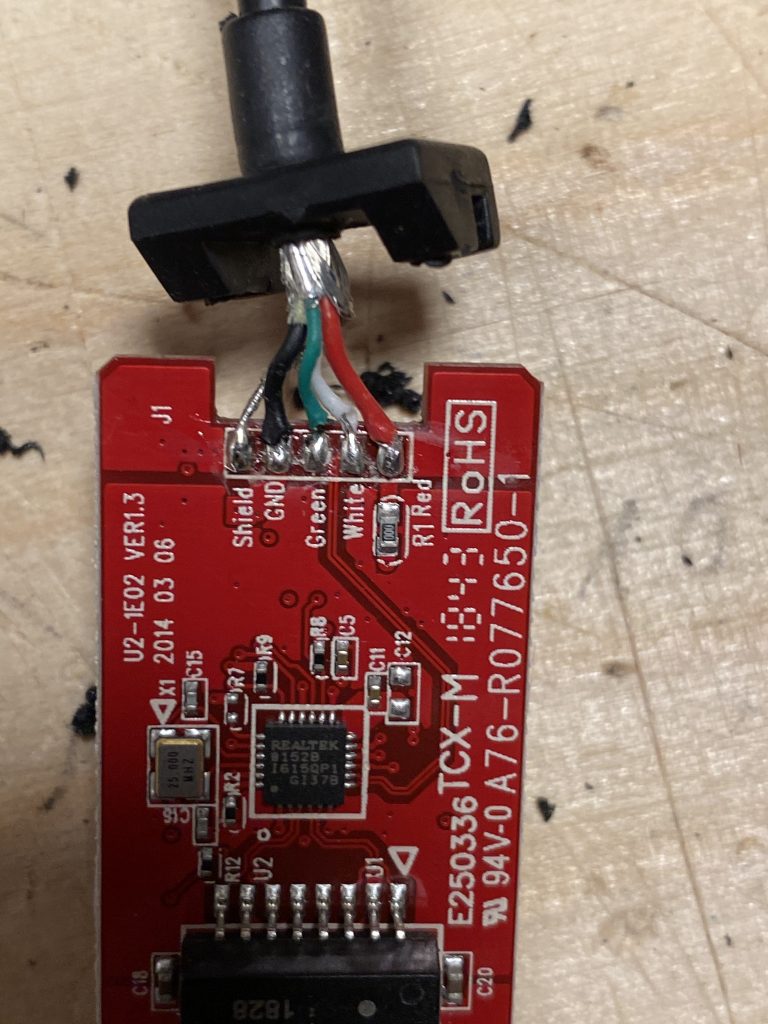

Ich habe einen USB zu Ethernet Adapter aufgesägt und die Platine auf den Raspberry Pi zero geklebt. Die USB Anschlüsse habe ich direkt auf die Platine gelötet, da die Stecker an der Seite zuviel Platz wegnehmen.

Auf dem Raspberry pi zero läuft Buster mit motion für die Camera

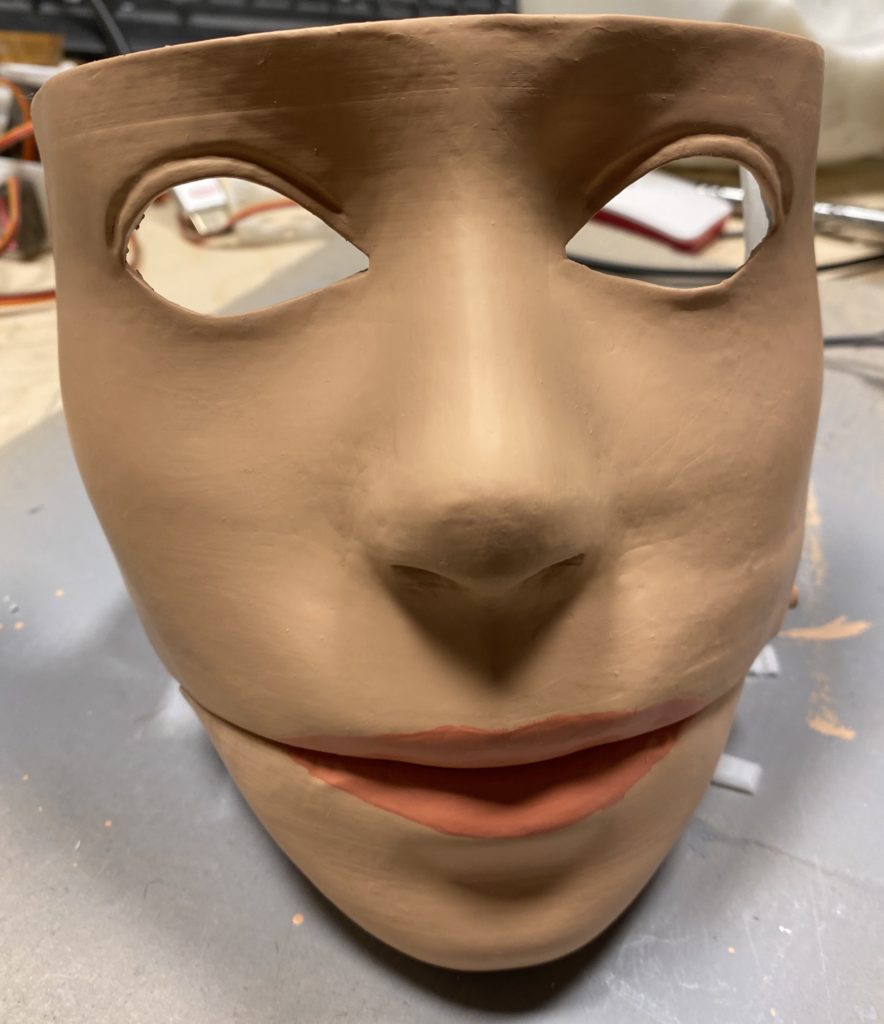

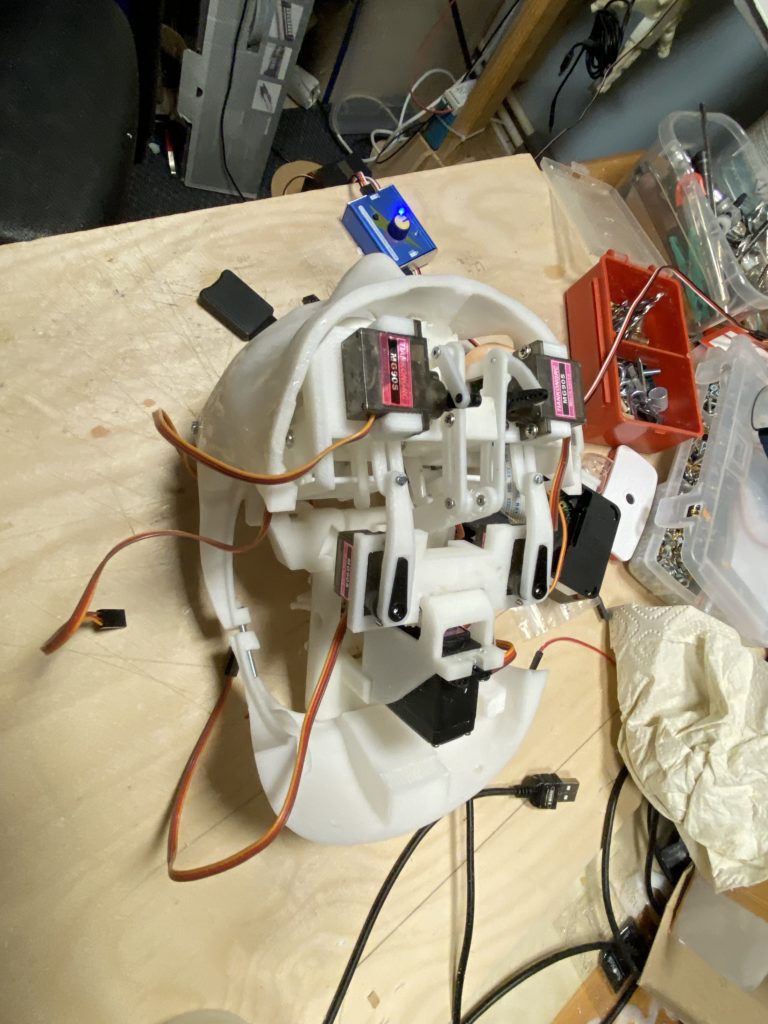

Auf dem rechten Bild sieht man die Flachbandkabel der Raspberry Pi Cam’s herausschauen

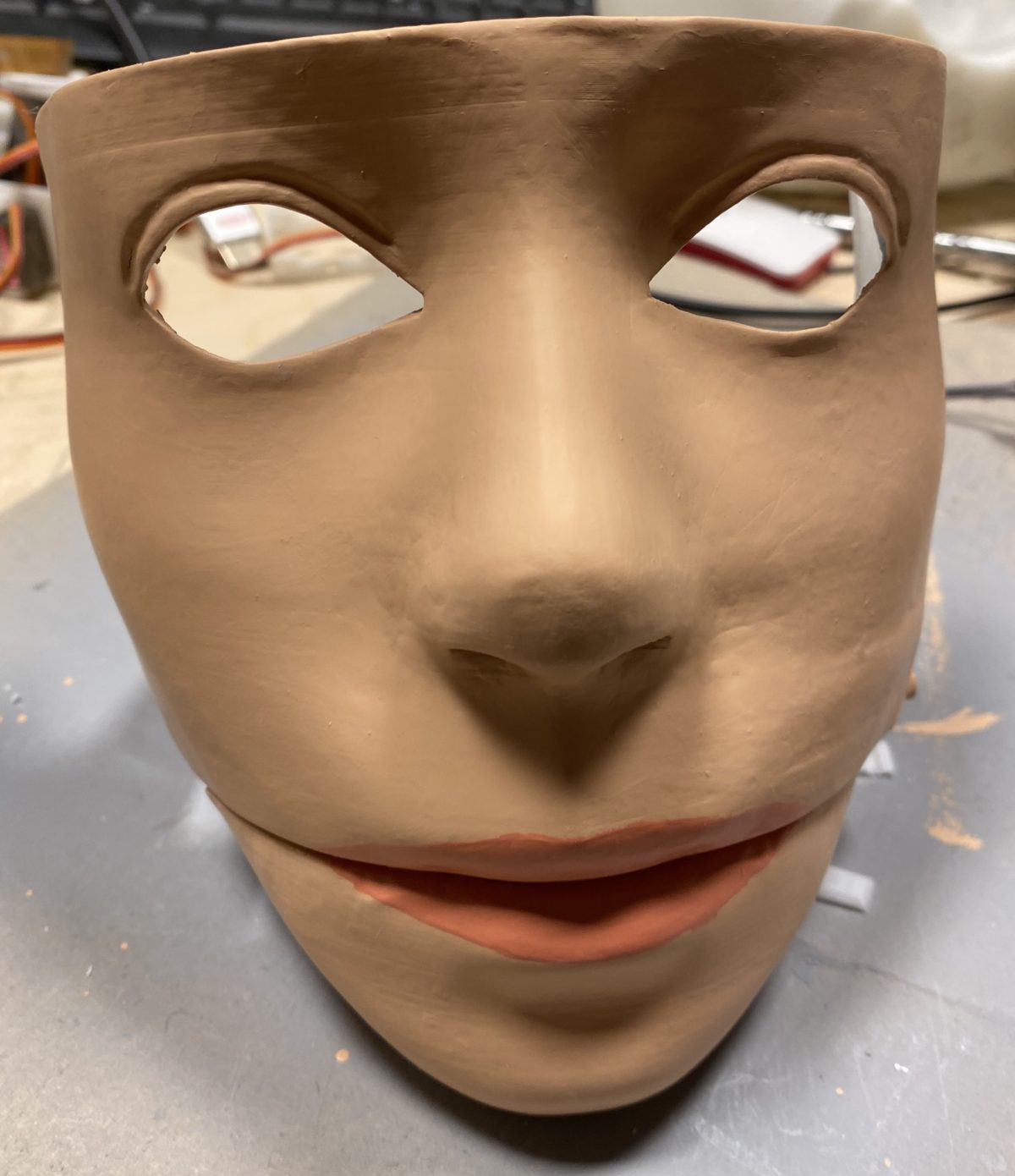

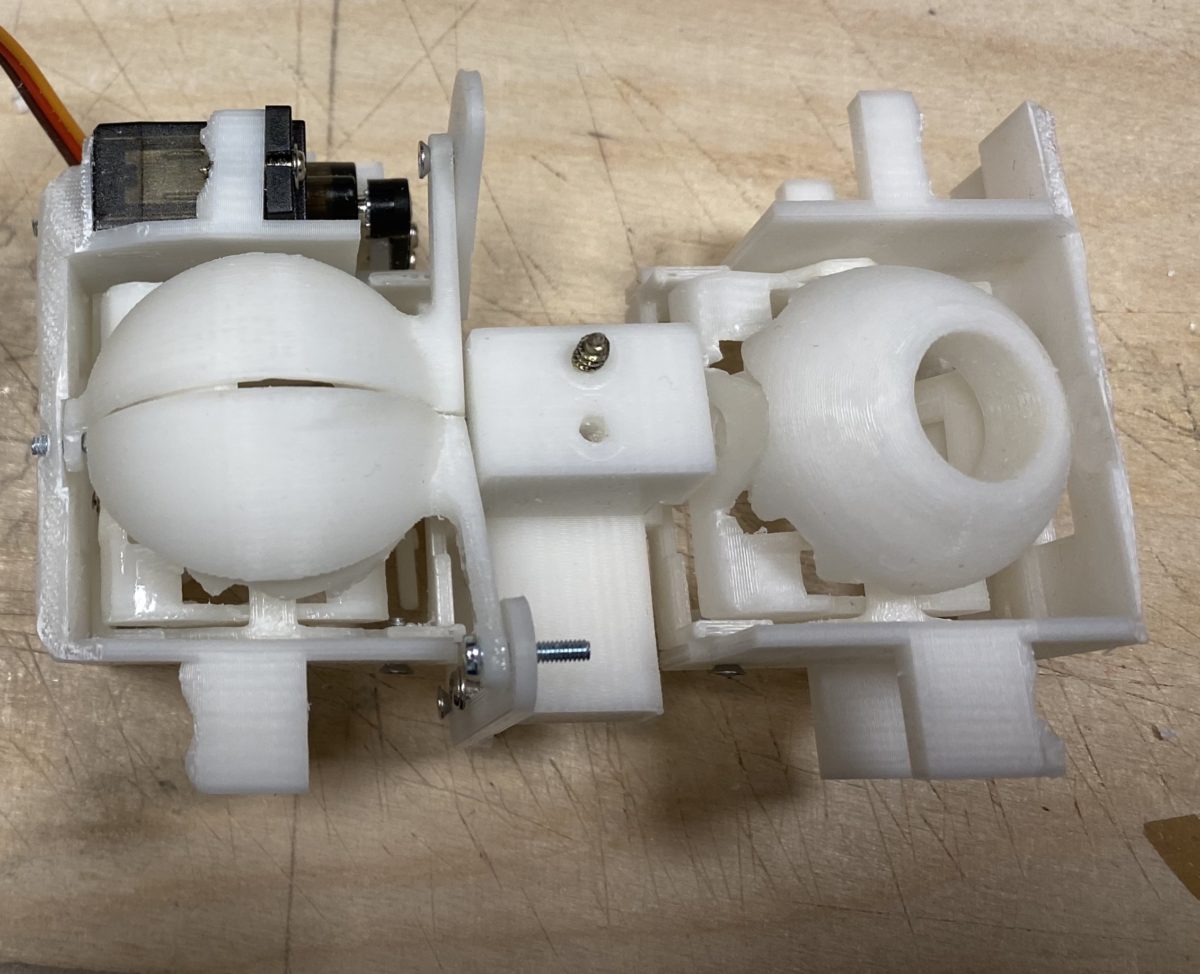

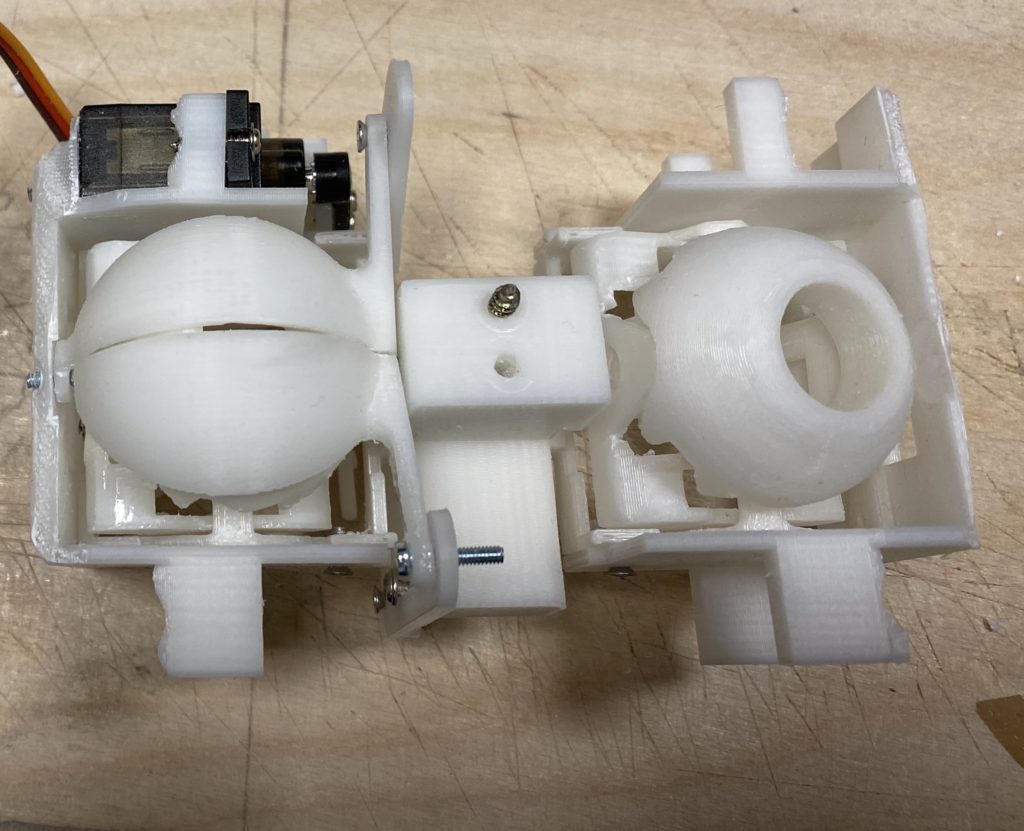

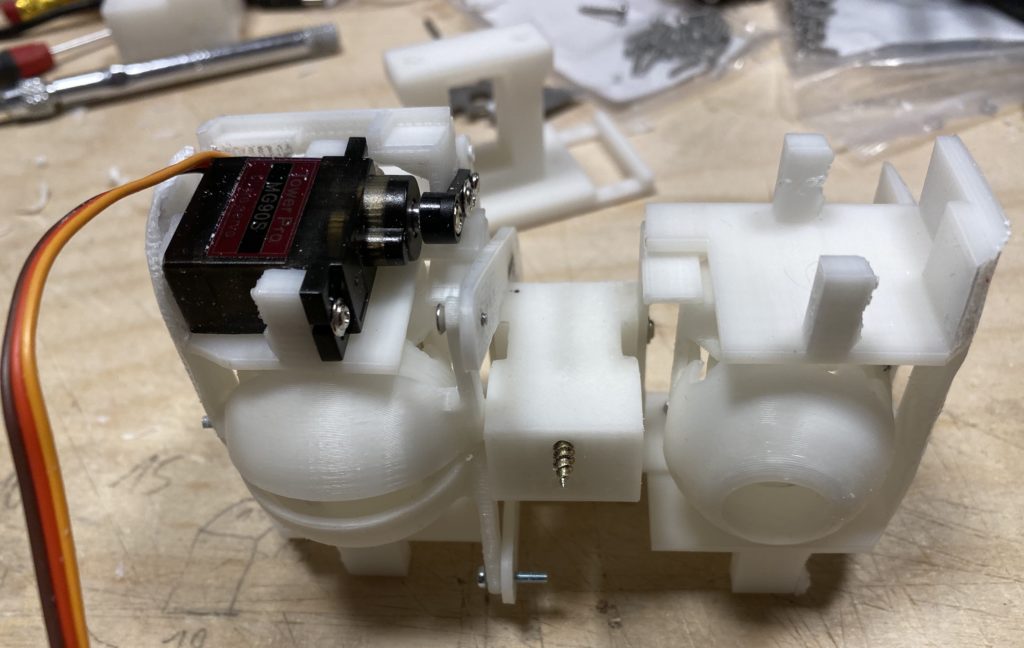

Ja demnächst nach dem die Teile in der Drehbank angepasst sind mehr

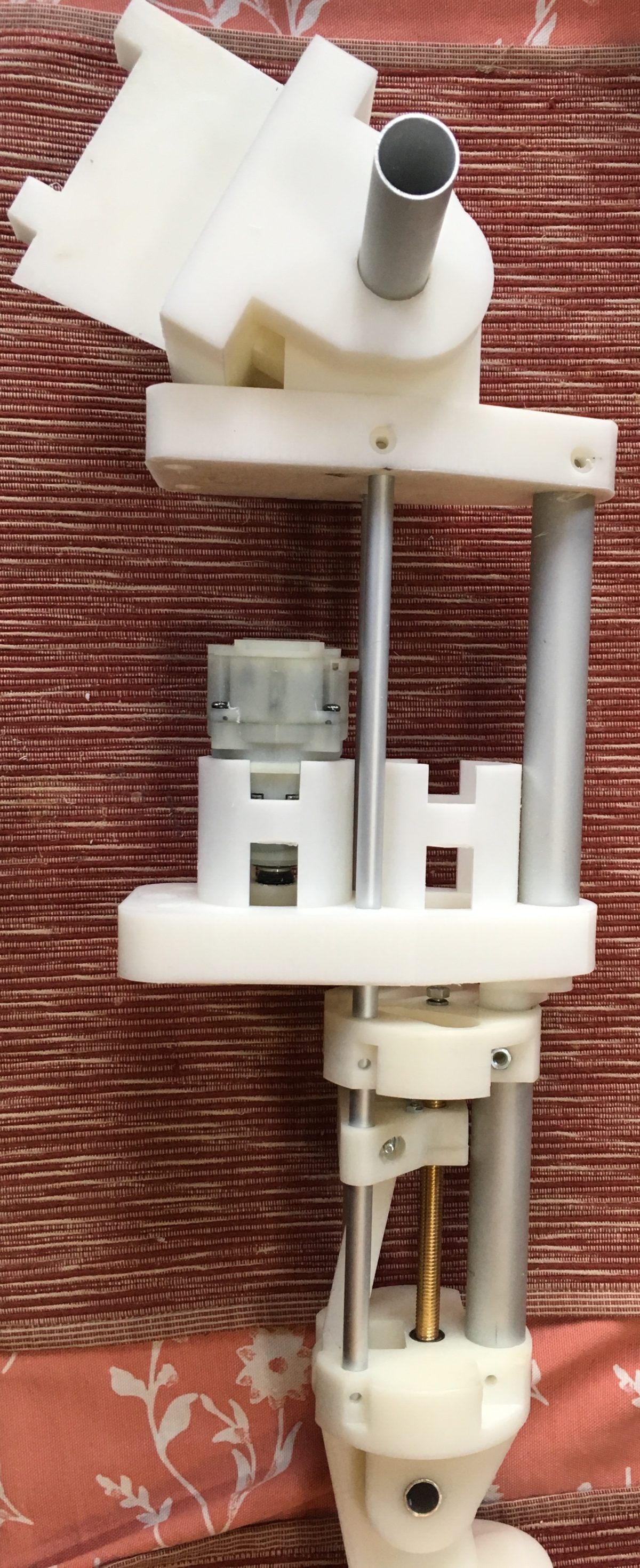

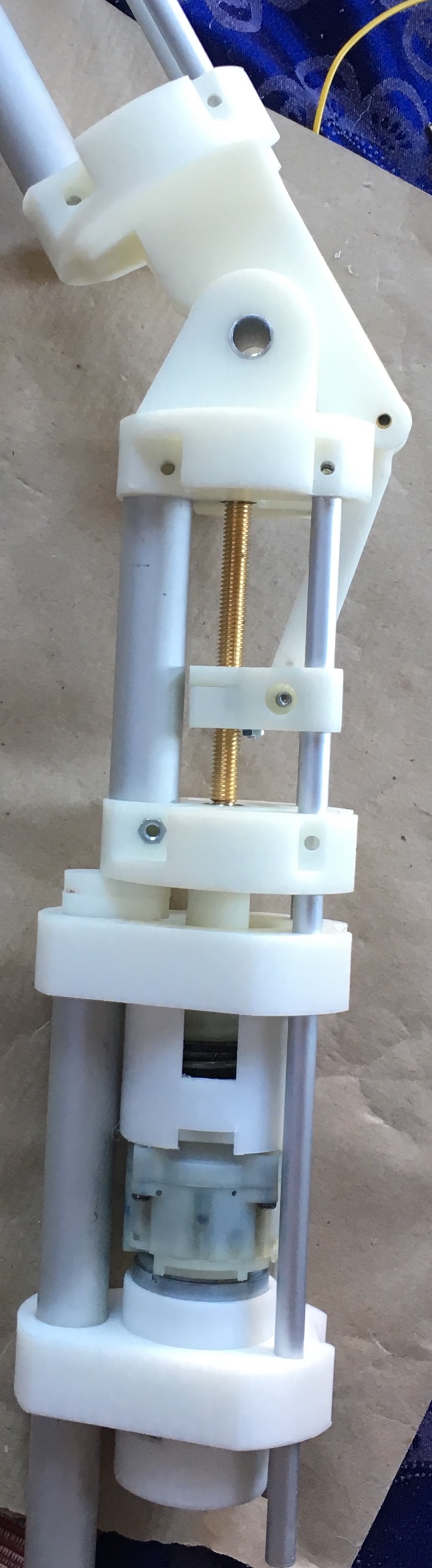

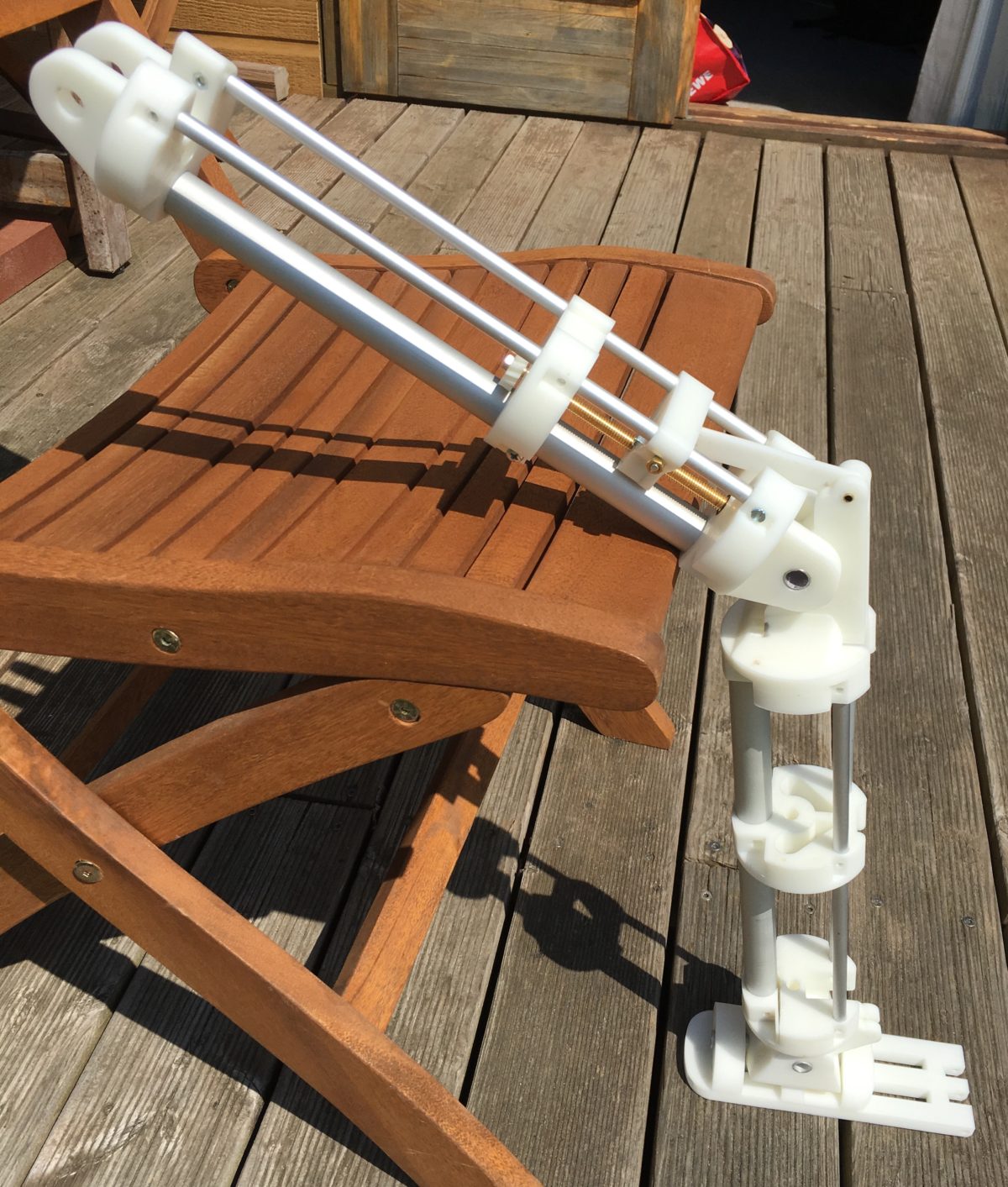

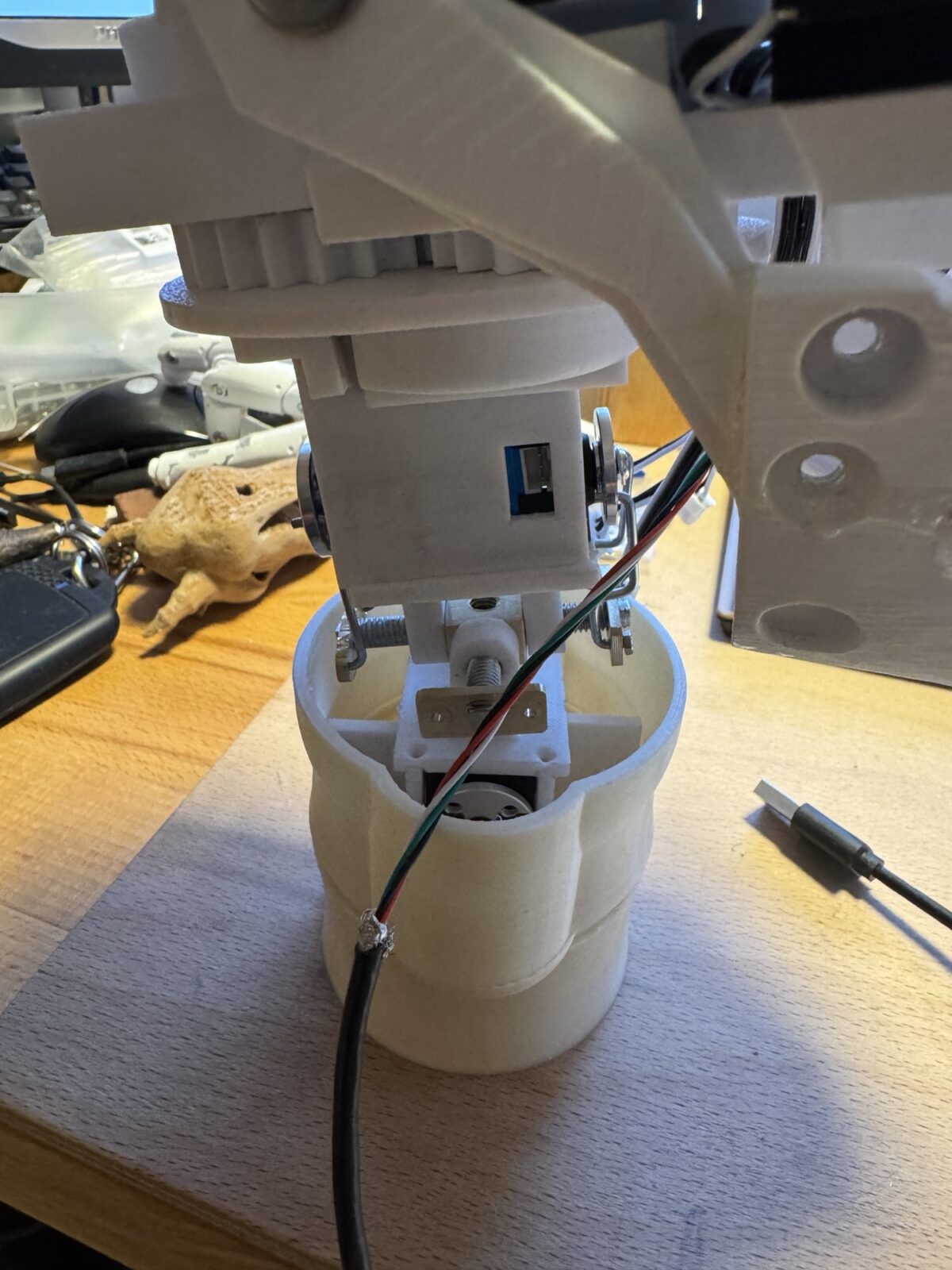

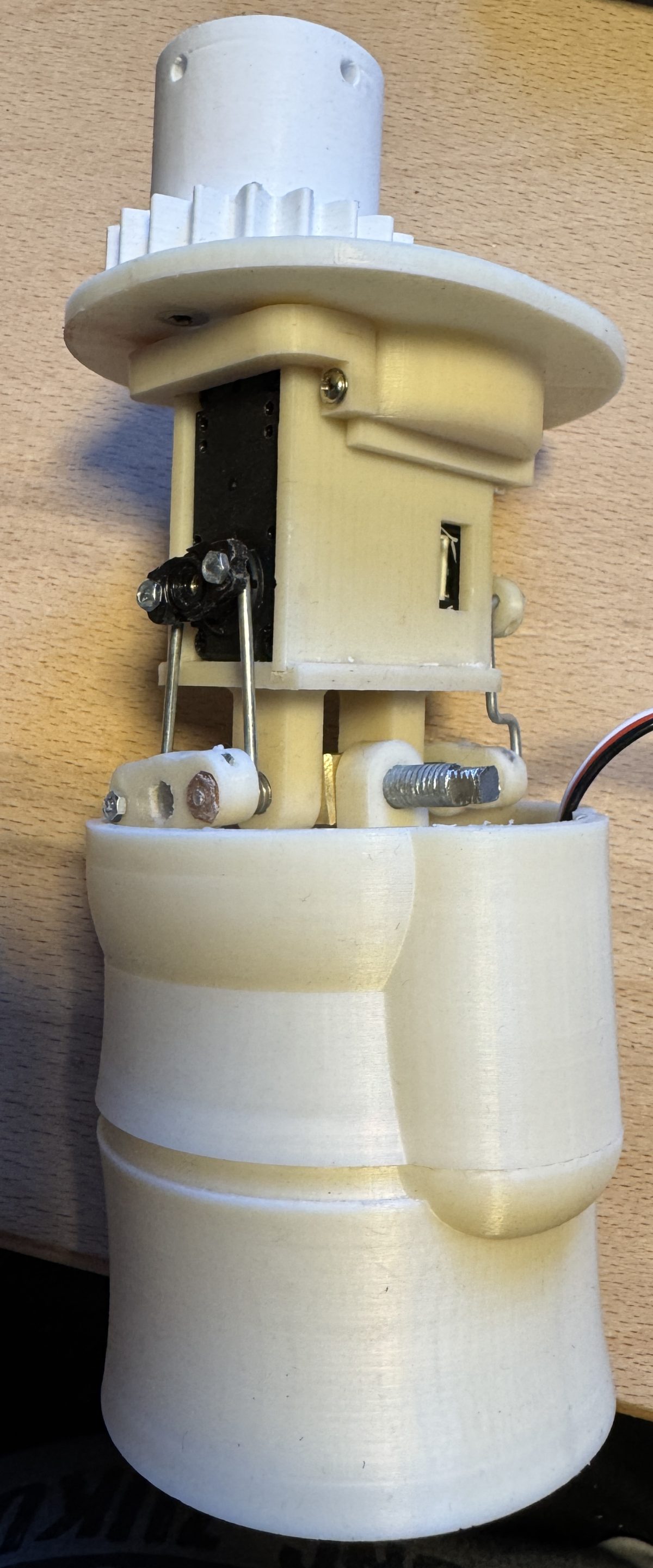

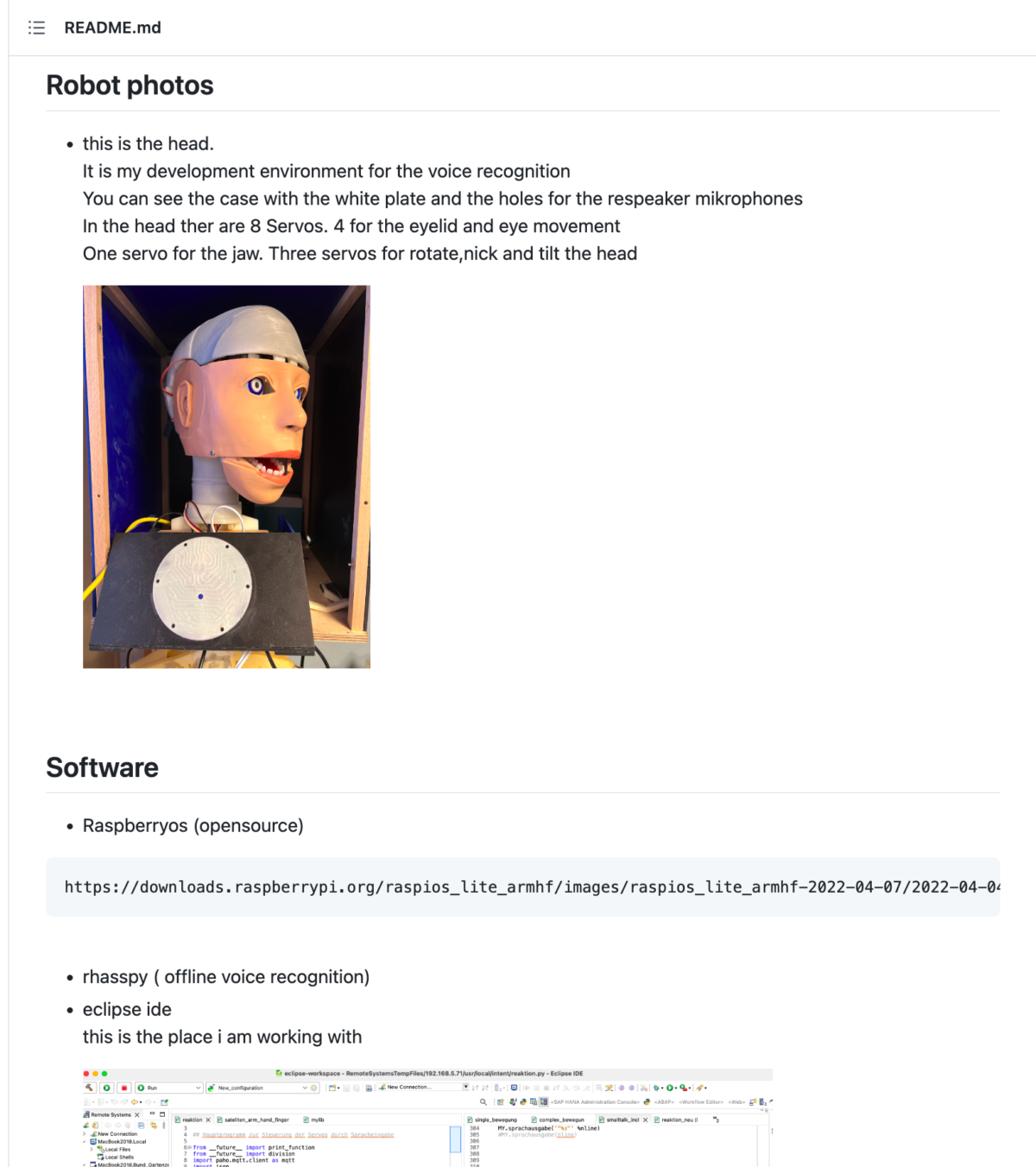

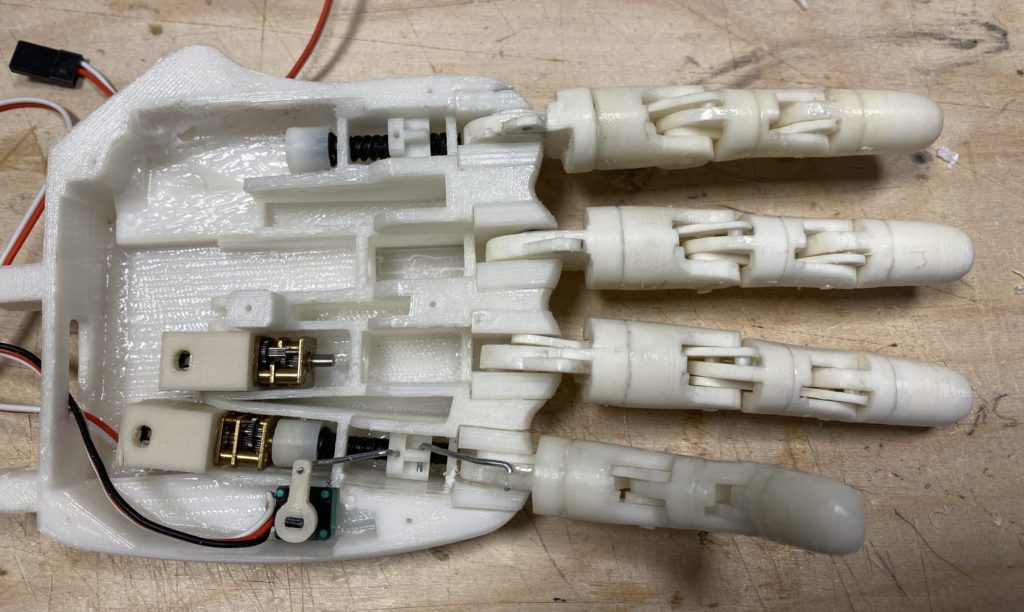

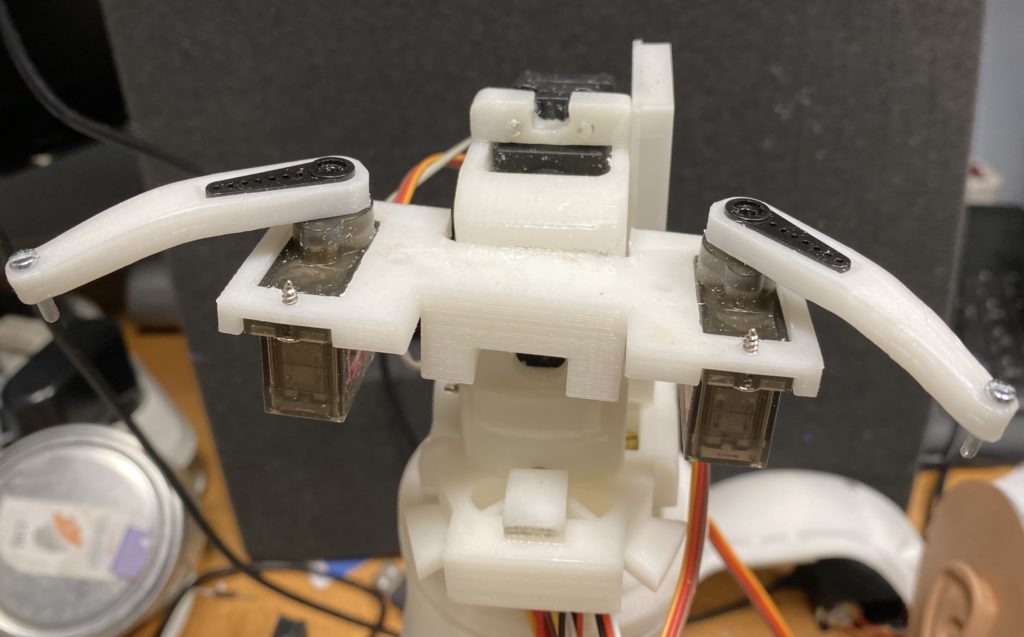

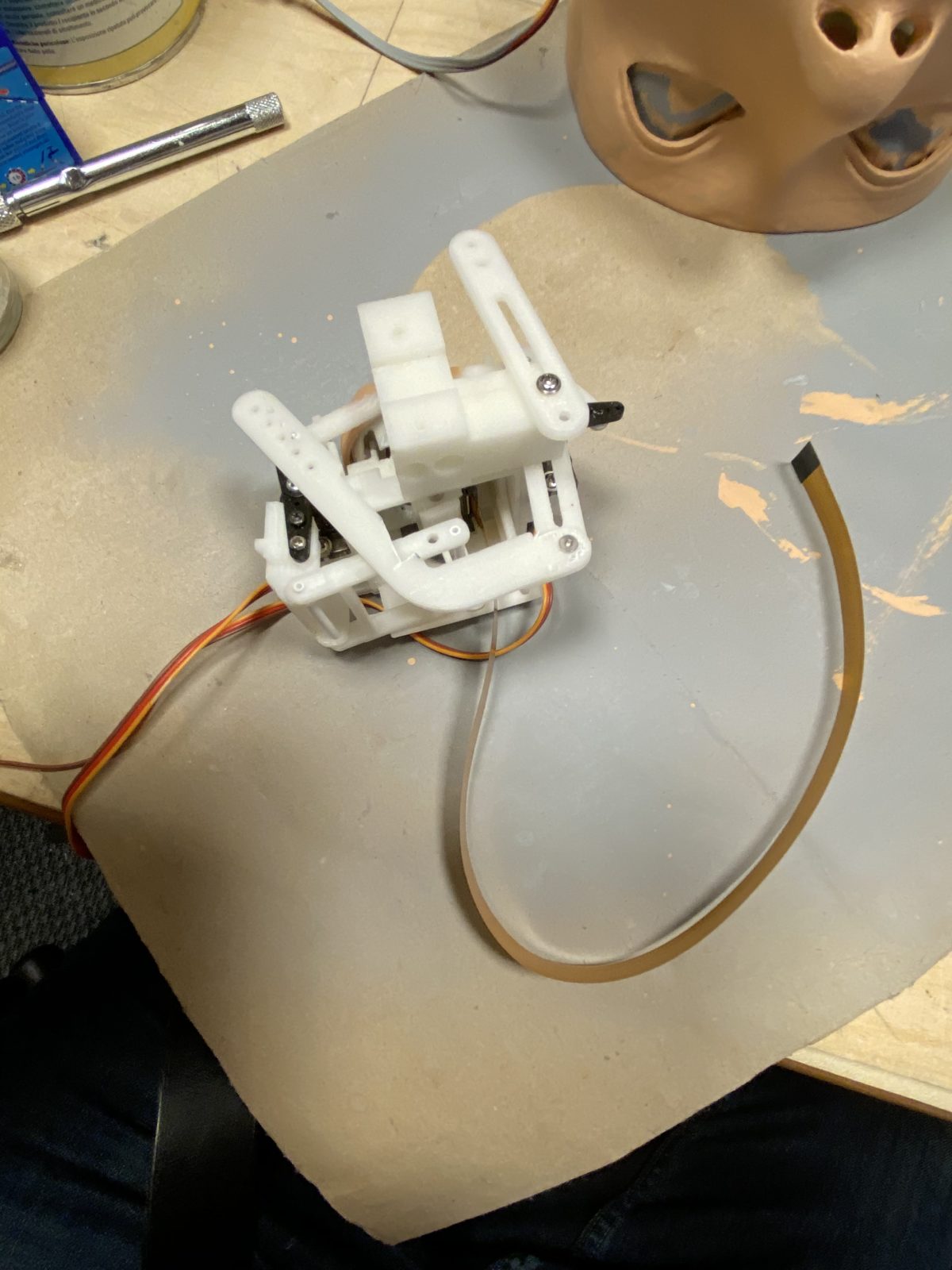

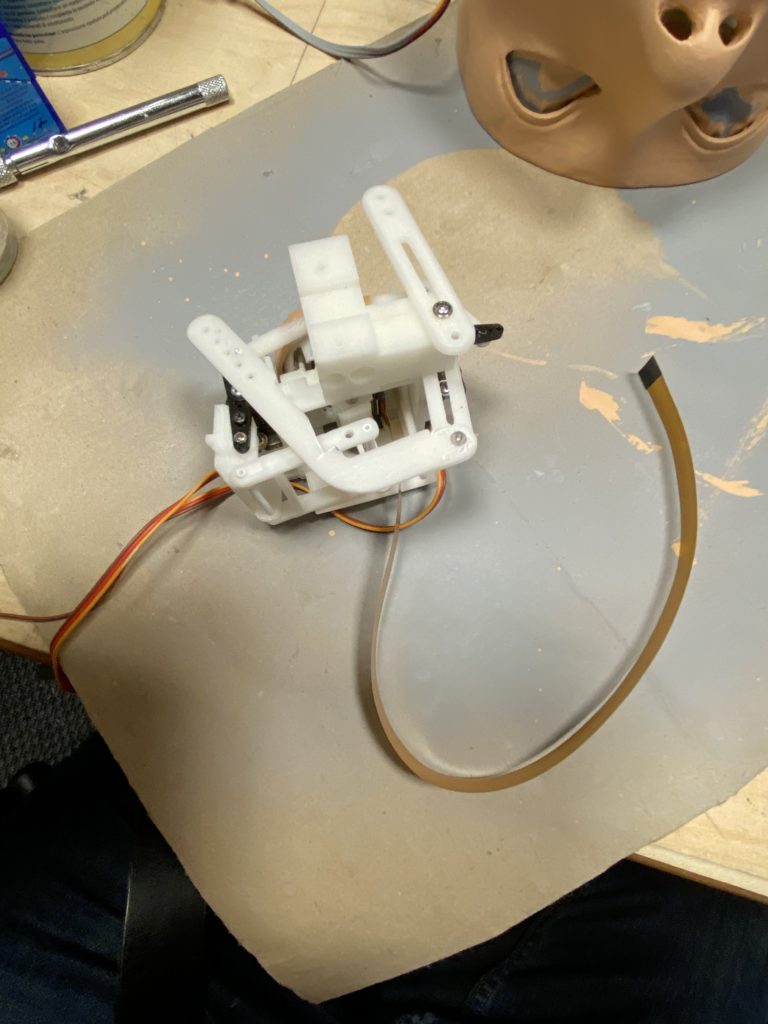

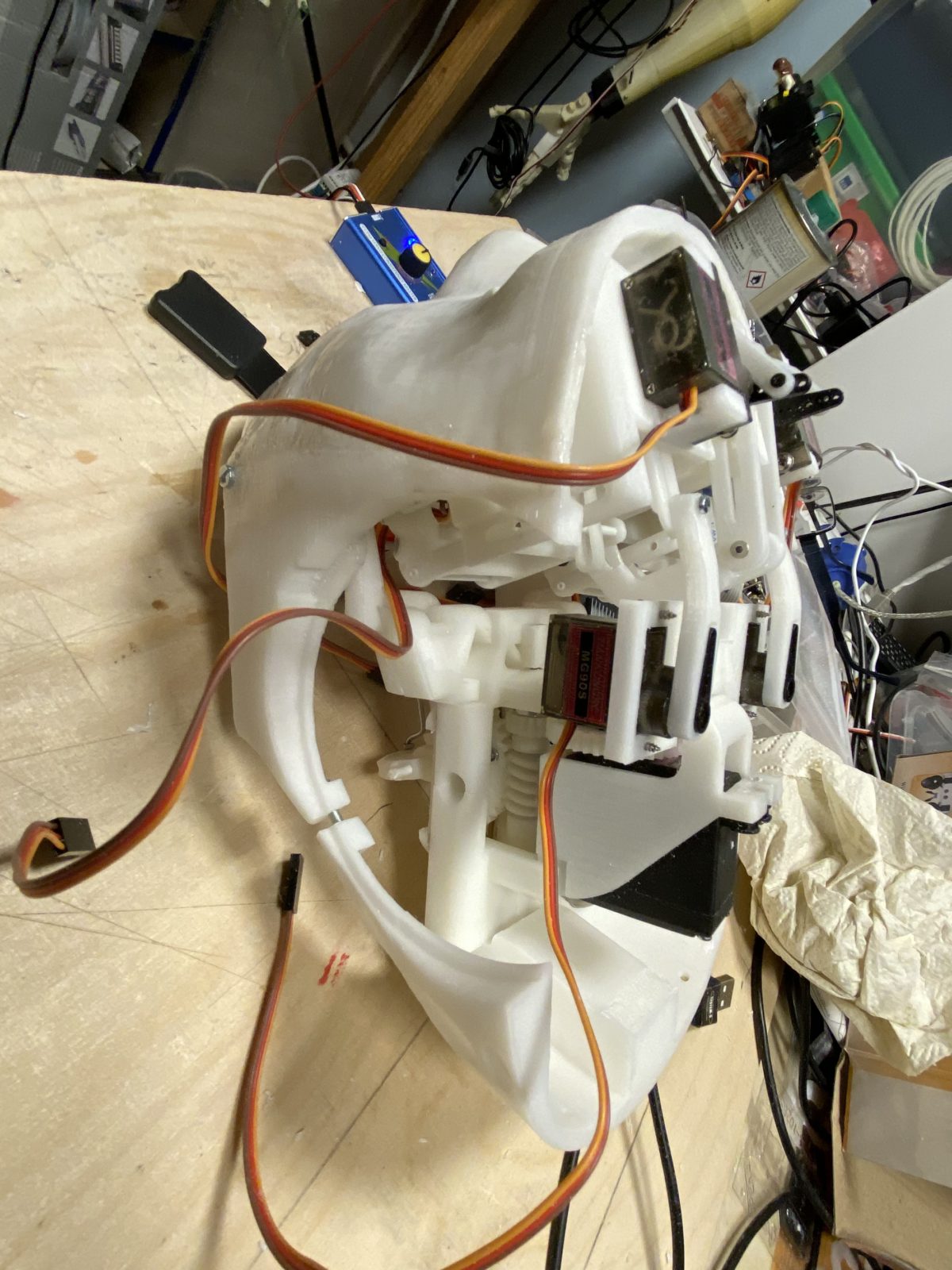

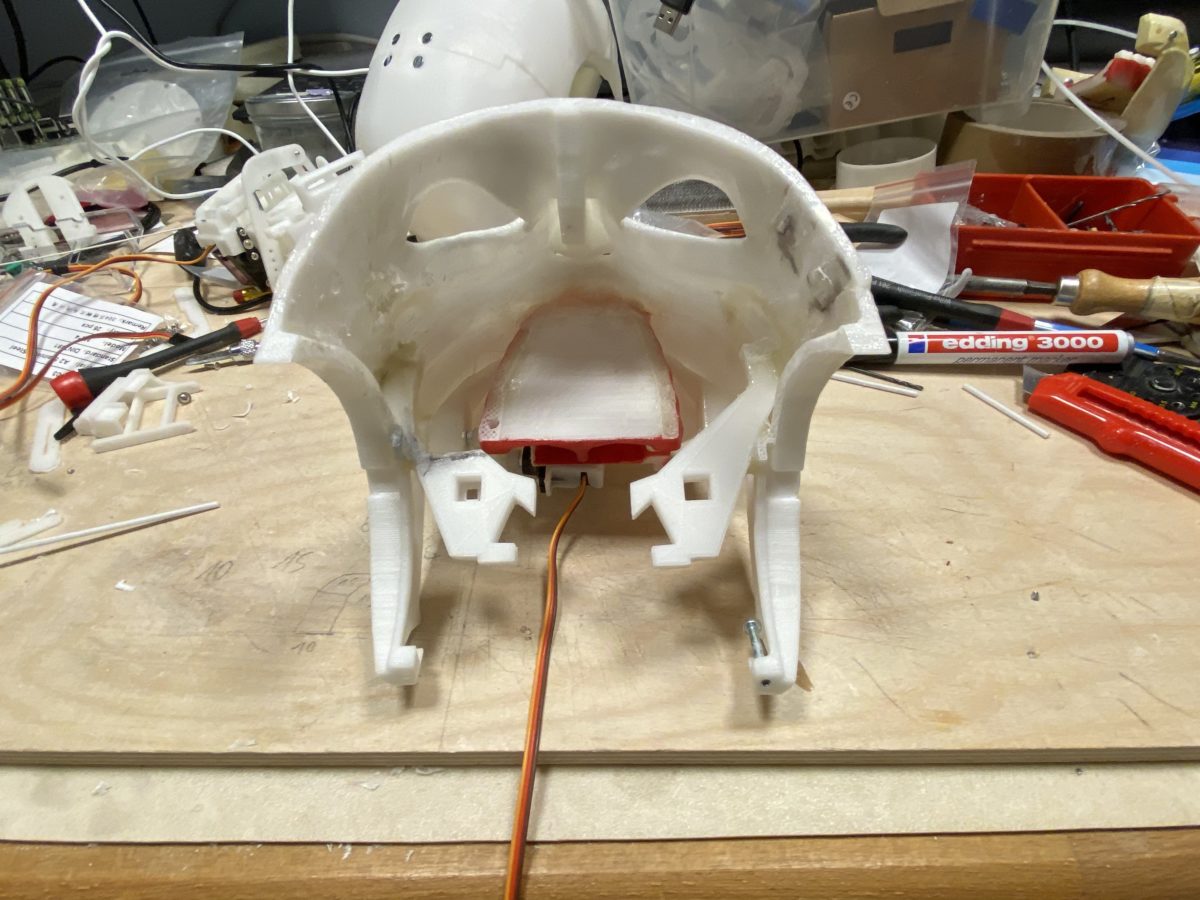

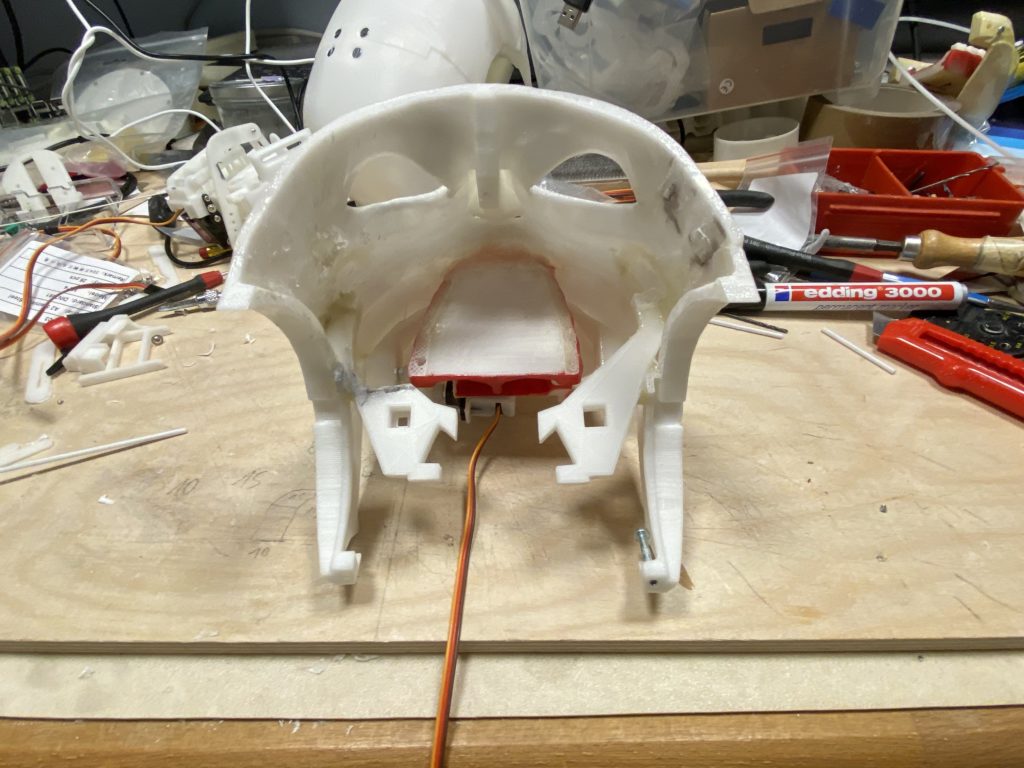

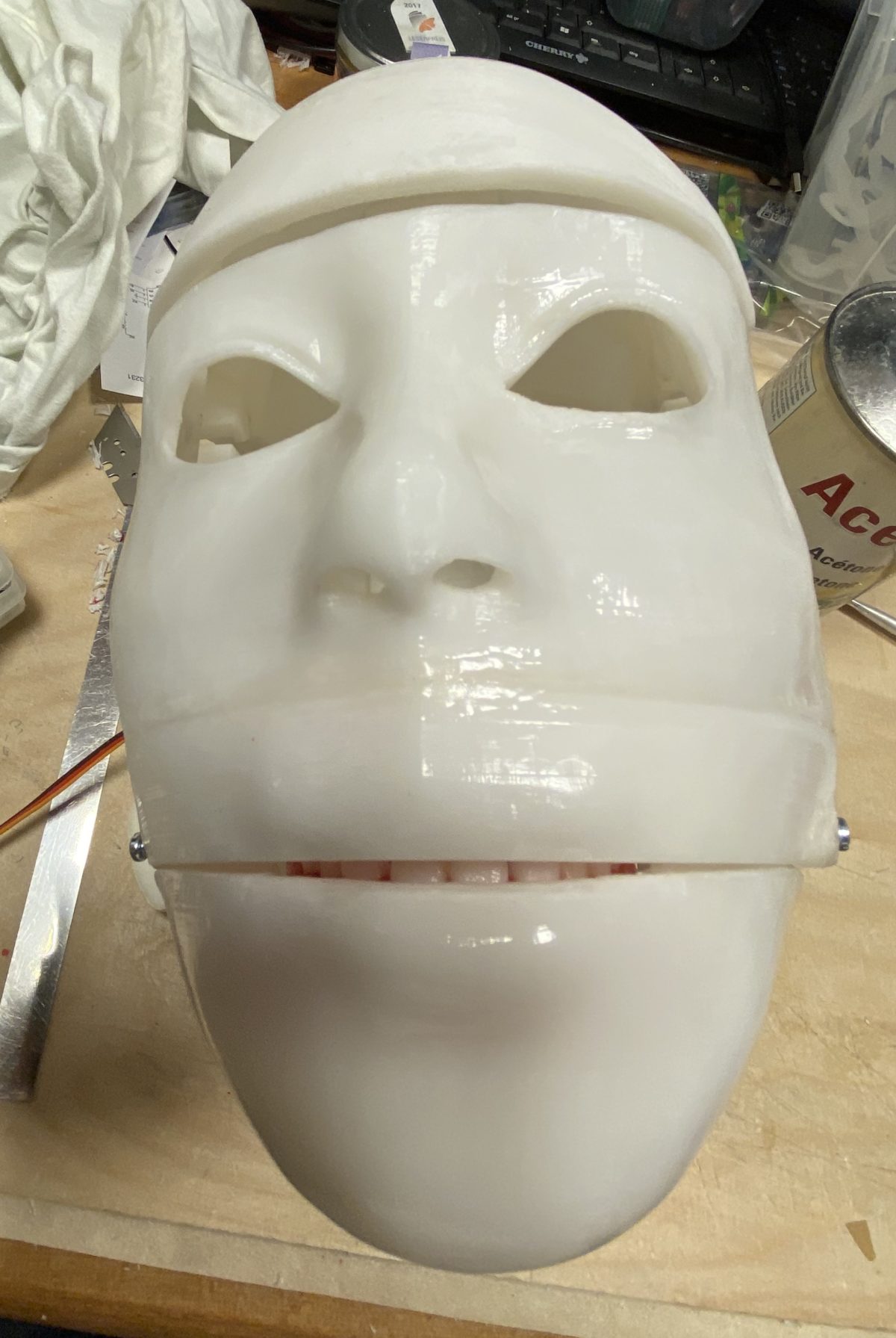

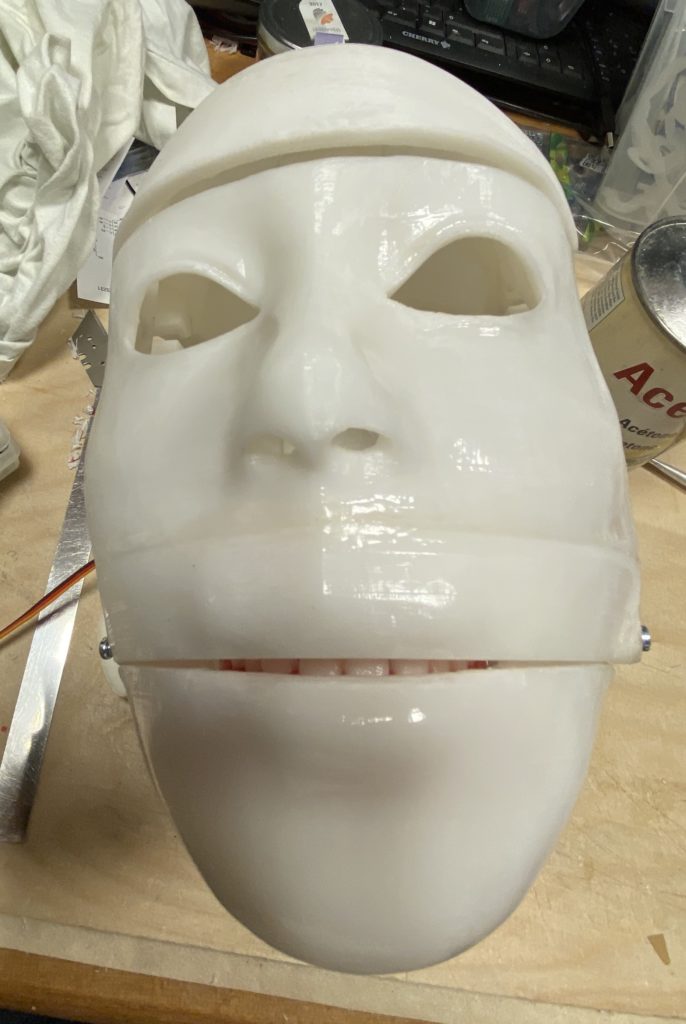

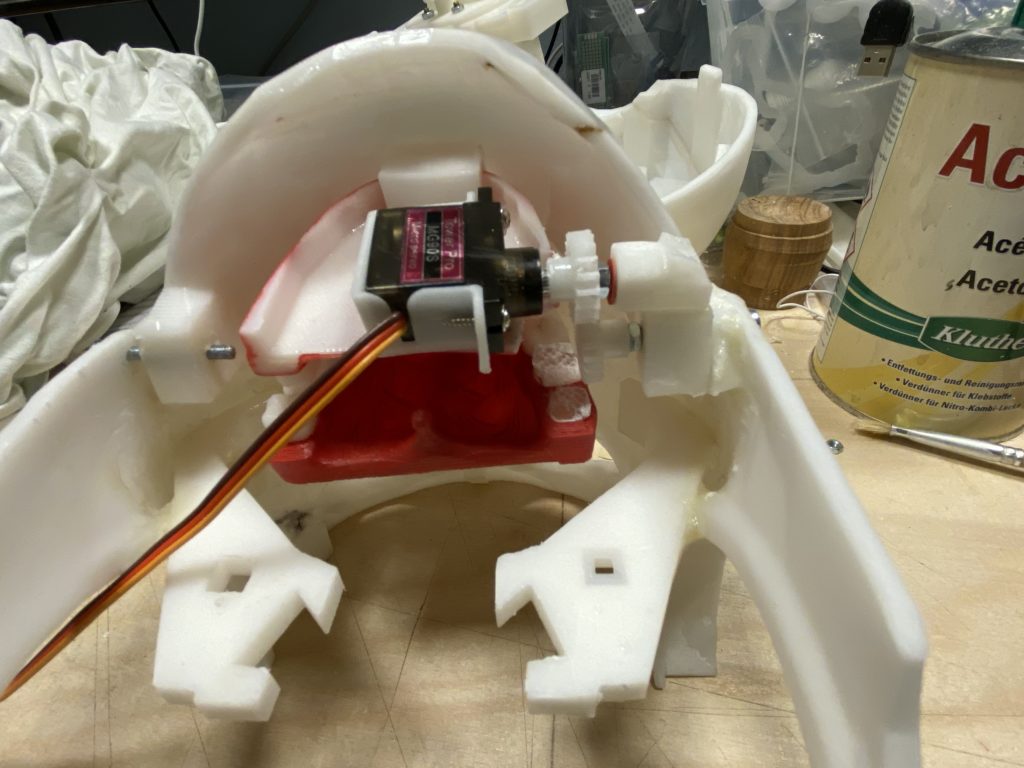

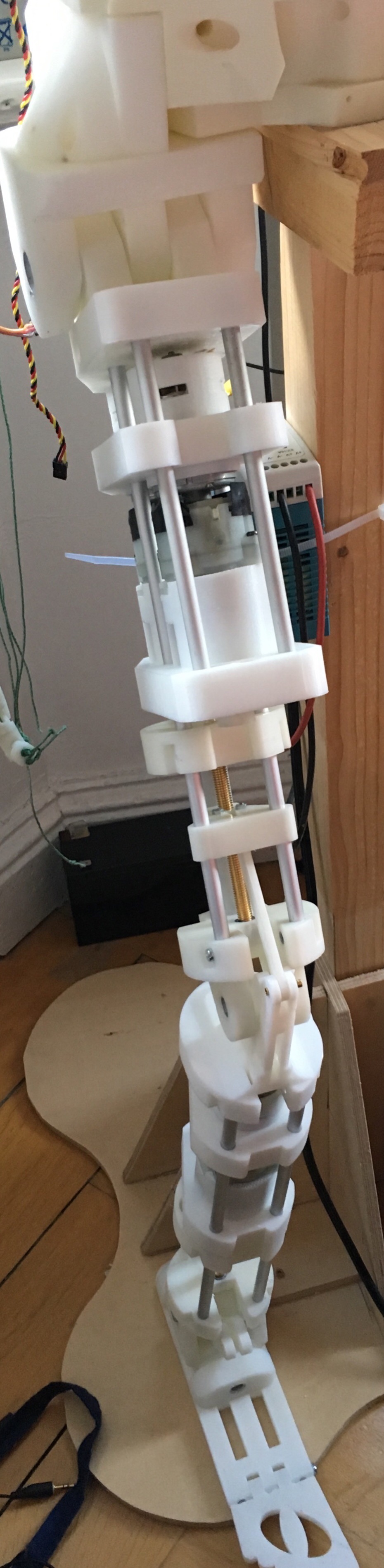

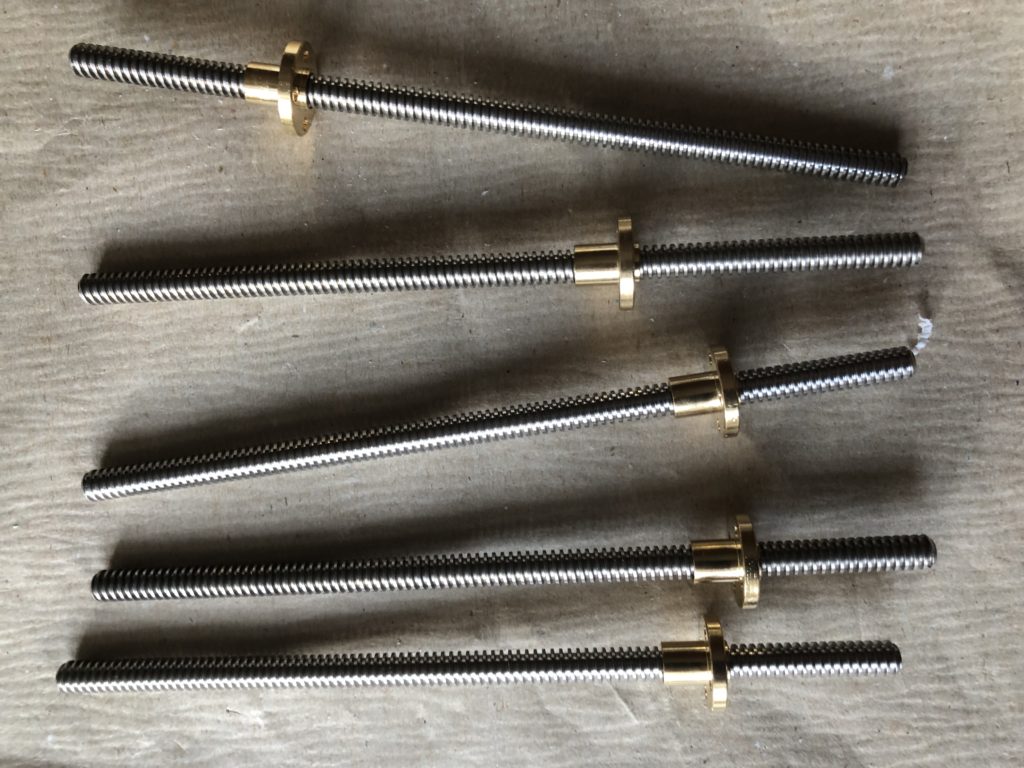

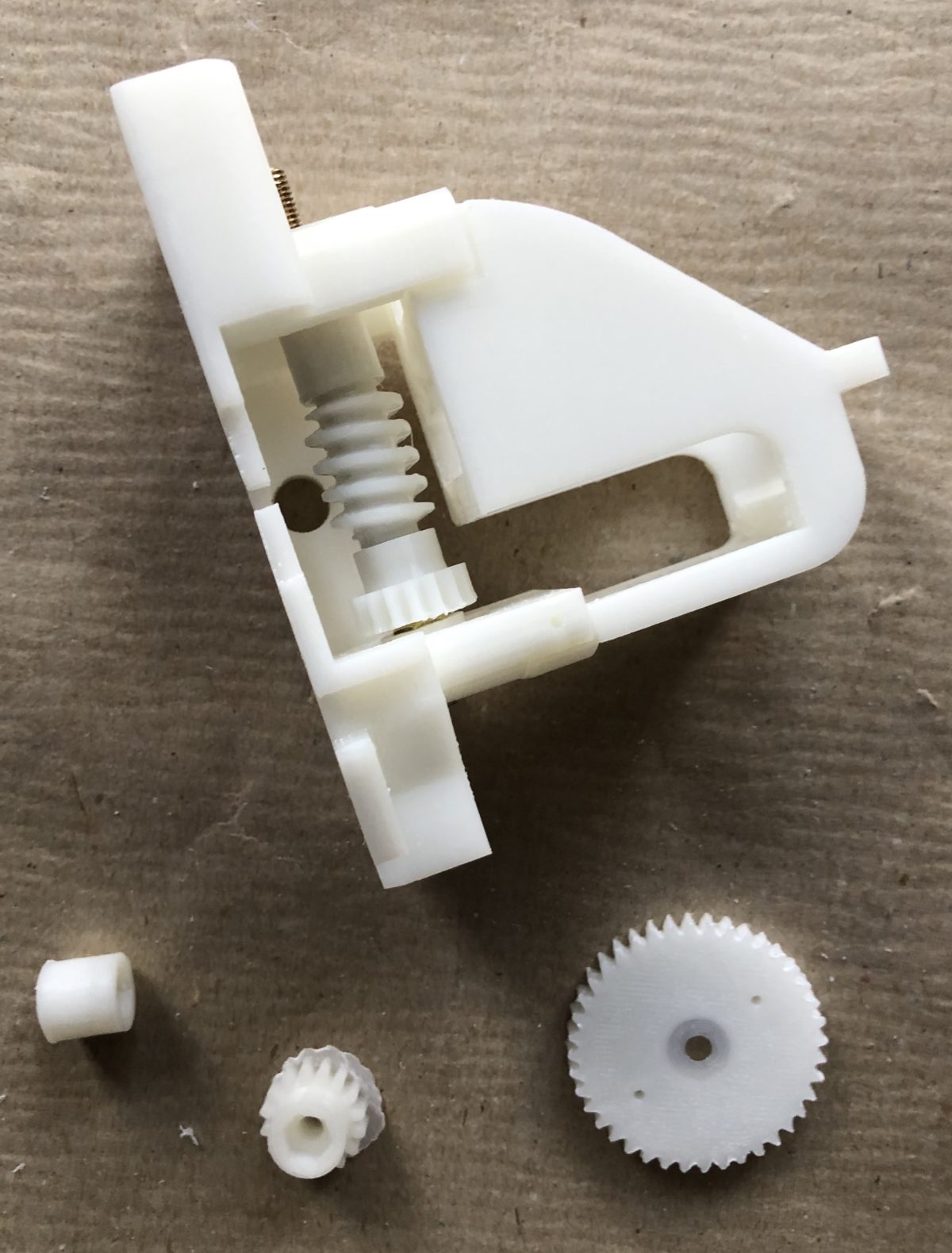

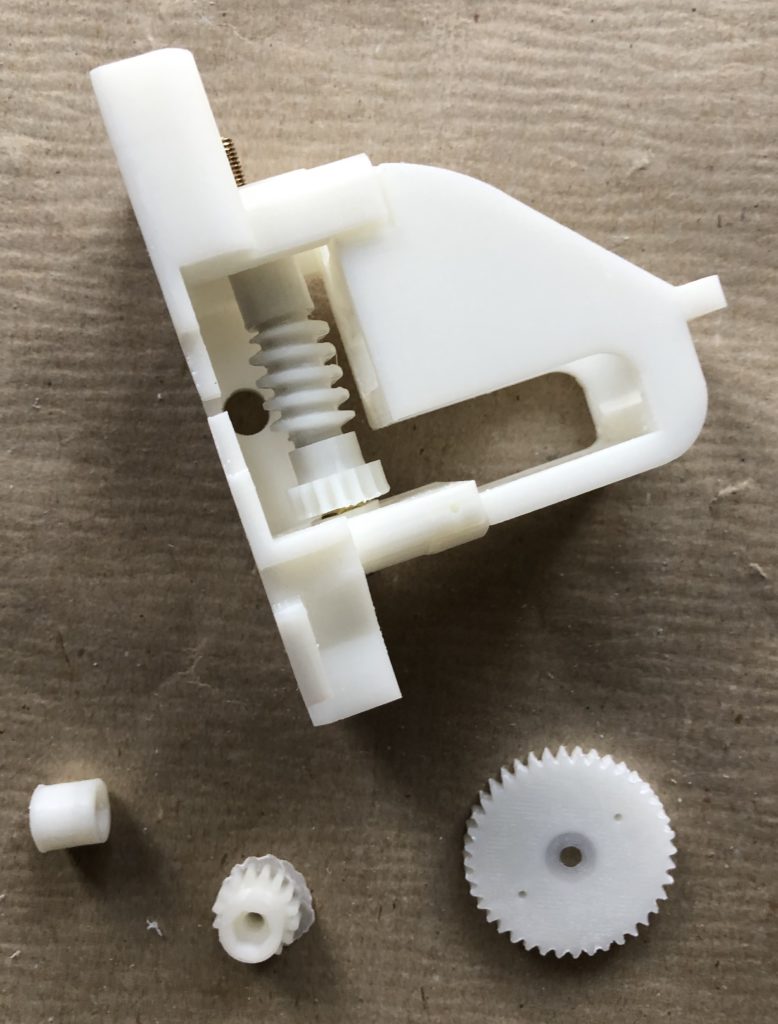

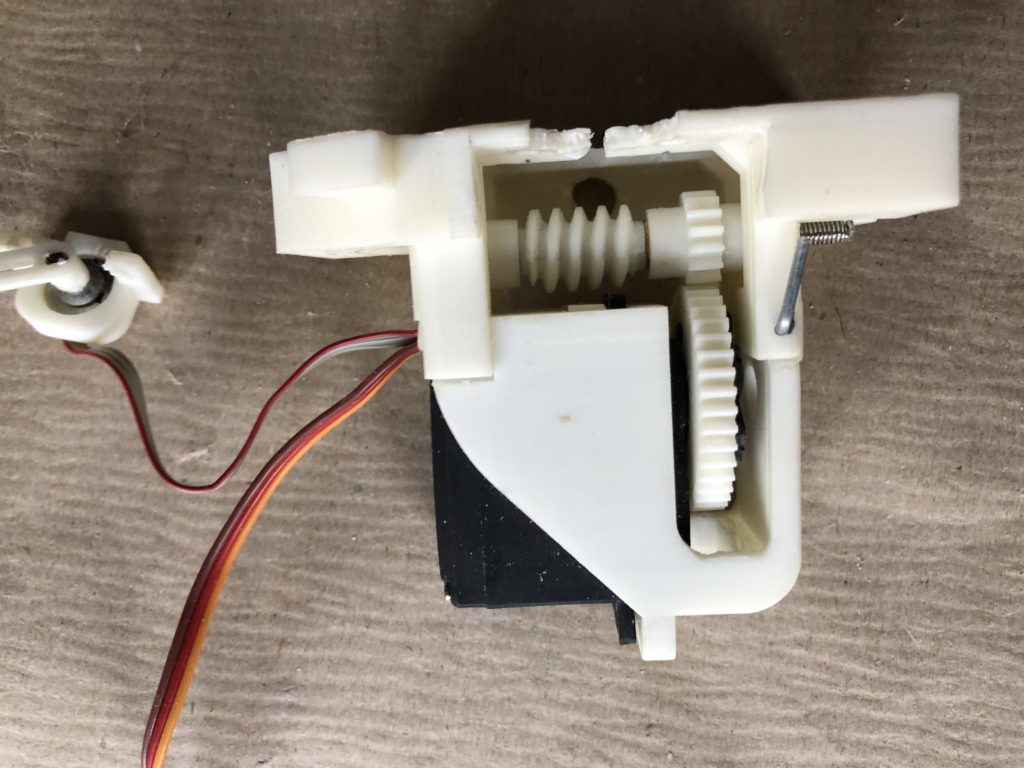

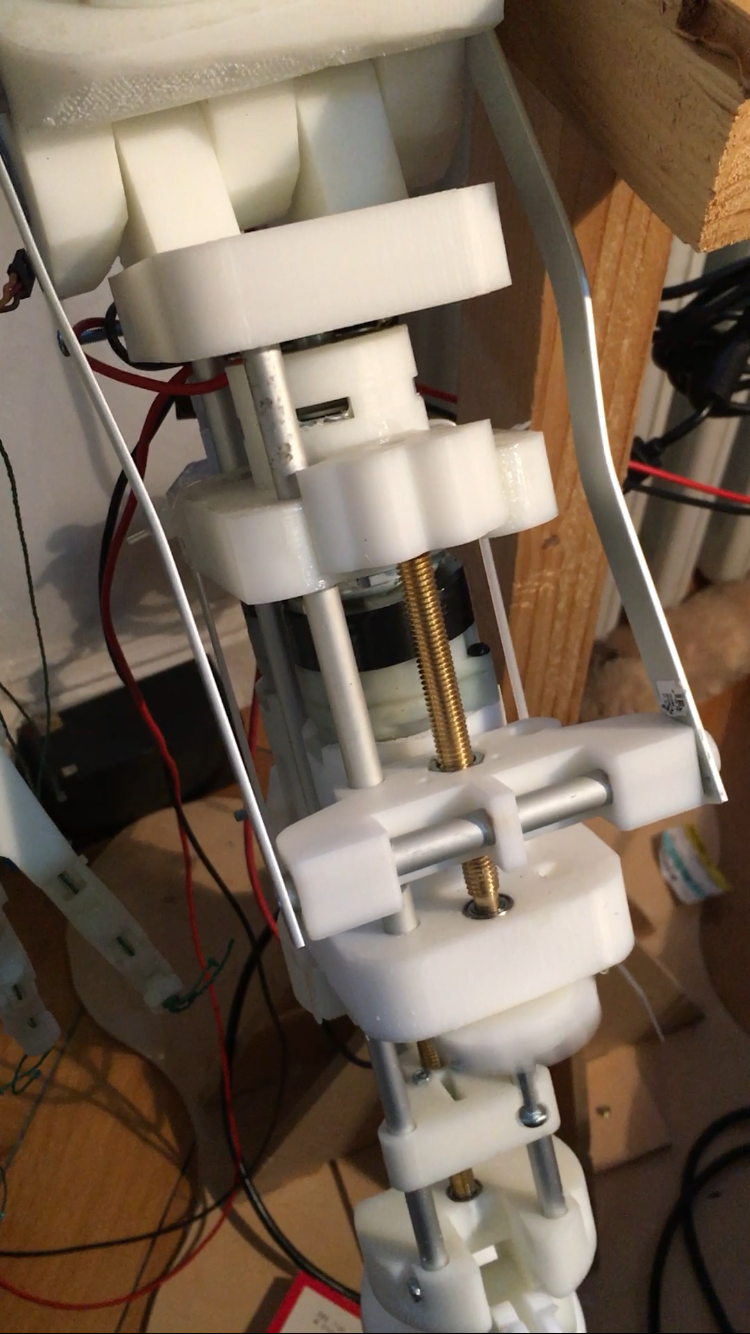

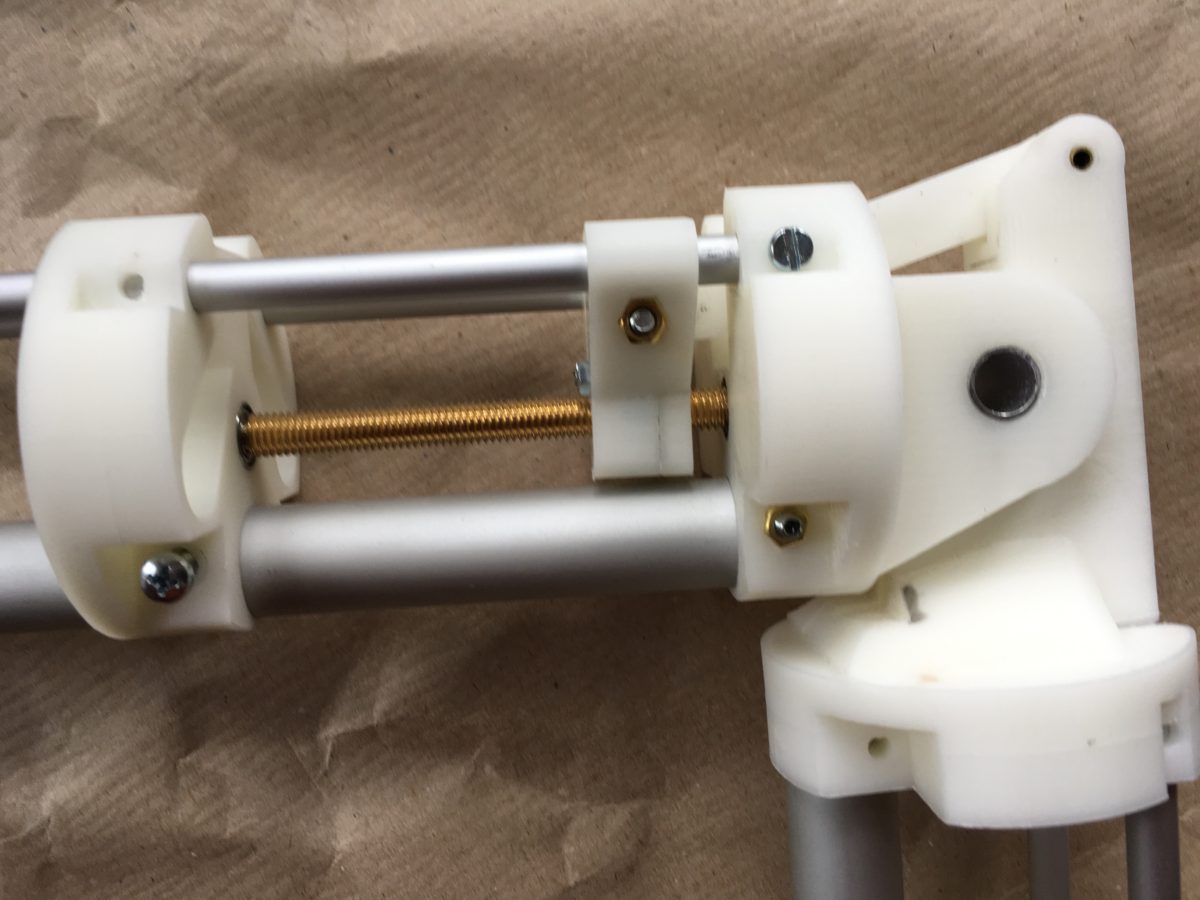

Beim neuen Hals läuft die Mechanik ohne größere Reibung

Die neue Version ist optimiert und ich musste keine größeren manuellen Arbeiten daran vornehmen. Leichter ist sie auch

Nur der Wetterbericht wird online geholt

Noch ein bischen wackelig aber ansonsten ok